Håndtering af risici ved kunstig intelligens for en mere sikker fremtid

Teknologier baseret på kunstig intelligens er hurtigt på vej ind i alle aspekter af livet: medicin, uddannelse, økonomi, sociale medier, selvkørende køretøjer, programmering osv. Fremskridtet kan ikke stoppes, så effekten af KI vil kun fortsætte med at vokse hvert år. I vores forrige artikel undersøgte vi risiciene ved kunstig intelligens, og nu vil vi undersøge, hvordan de negative faktorer, der er forbundet med brugen af KI, kan reduceres.

Værktøjer til afsløring af kunstig intelligens

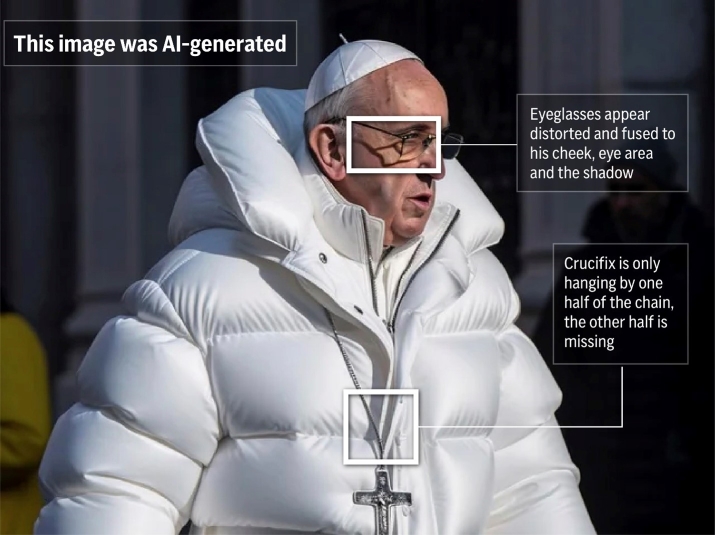

Ved hjælp af moderne teknologier er det muligt at opdigte lyd, fotos og videoer, skabe deepfakes, manipulere den offentlige mening, efterligne en anden persons stemme og forfalske beviser.

Forskere arbejder nu på at finde måder at opdage forfalskninger på, så de kan afgøre, om en lyd- eller videooptagelse er blevet ændret eller helt genereret af kunstig intelligens.

Registrering af genererede billeder

- Intel har skabt den første deepfake-detekteringsplatform i realtid nogensinde baseret på FakeCatcher-teknologi. Teknologien bruger fjernfotoplethysmografiteknikker til at analysere den subtile "blodgennemstrømning" i et billedes pixels. Signalerne fra flere billeder behandles gennem en klassifikator for at afgøre, om den pågældende video er ægte eller falsk.

- Det amerikanske regeringsagentur DARPA arbejder på SemaFor-teknologier (forkortelse for Semantic Forensics), der præcist kan opdage syntetiske, kunstigt genererede billeder.

Desuden findes der allerede dusinvis af forskellige værktøjer, der har til formål at opdage genererede billeder og tekst.

Kritisk tænkning

Desinformation, propaganda og forskellige metoder til bedrag har eksisteret længe før opfindelsen af kunstig intelligens. Måske er du eller nogen, du kender, blevet udsat for svindlere. Nogle mennesker lader sig let narre af svindelnumre som den nigerianske prins' arvemail, mens andre er mere skeptiske og tænker kritisk. Med fremkomsten af teknologi, der kan manipulere billeder, lyd og video, skal vi nu være endnu mere omhyggelige med at tjekke fakta.

Futuristen Mark Ford sagde: "Ingen ved, hvad der er virkeligt, og hvad der ikke er. Så det fører virkelig til en situation, hvor du bogstaveligt talt ikke kan tro på dine egne øjne og ører; du kan ikke stole på det, vi historisk set har anset for at være de bedst mulige beviser."

Bekæmpelse af svindel og misinformation vil være en cyklisk proces: Når der opstår nye måder at opdage bedrag på, vil andre udvikle måder at modvirke dem på, hvilket fører til oprettelse af endnu flere beskyttelsesforanstaltninger. Selv om det måske ikke giver fuldstændig beskyttelse, vil vi ikke være forsvarsløse.

Falsk foto af pave Frans

Skabelse af nye jobs

Den udbredte anvendelse af kunstig intelligens medfører en risiko for tab af arbejdspladser. Vi har diskuteret dette problem i detaljer i en af de tidligere artikler. Der kan du også finde links til undersøgelser og finde ud af, hvilke erhverv der er mest udsatte, og hvilke der ikke er det.

Selvfølgelig vil mange mennesker miste deres job på grund af kunstig intelligens (ifølge forskellige skøn fra 100 til 800 millioner mennesker), og nogle vil være nødt til at gennemgå professionel omskoling (Seo.ai anslår deres antal til 120 millioner mennesker).

KI vil dog ikke kun fjerne jobs, men også skabe nye. Desuden er et scenarie muligt, hvor nye job opstår hurtigere, end gamle forsvinder. Her er, hvad World Economic Forum skriver om det:

Selv om antallet af ødelagte job vil blive overgået af antallet af skabte "morgendagens job", er jobskabelsen i modsætning til tidligere år aftagende, mens jobødelæggelsen accelererer. Baseret på disse tal anslår vi, at 85 millioner job i 2025 kan blive fortrængt af et skift i arbejdsdelingen mellem mennesker og maskiner, mens 97 millioner nye roller kan opstå.

Blandt disse nye jobs er:

- Ingeniører inden for KI-modeller og -prompts

- Interface- og interaktionsdesignere

- Skabere af KI-indhold

- Datakuratorer og -undervisere

- Specialister i etik og styring

Nogle af de nye jobs

Omfavnelse af teknologien

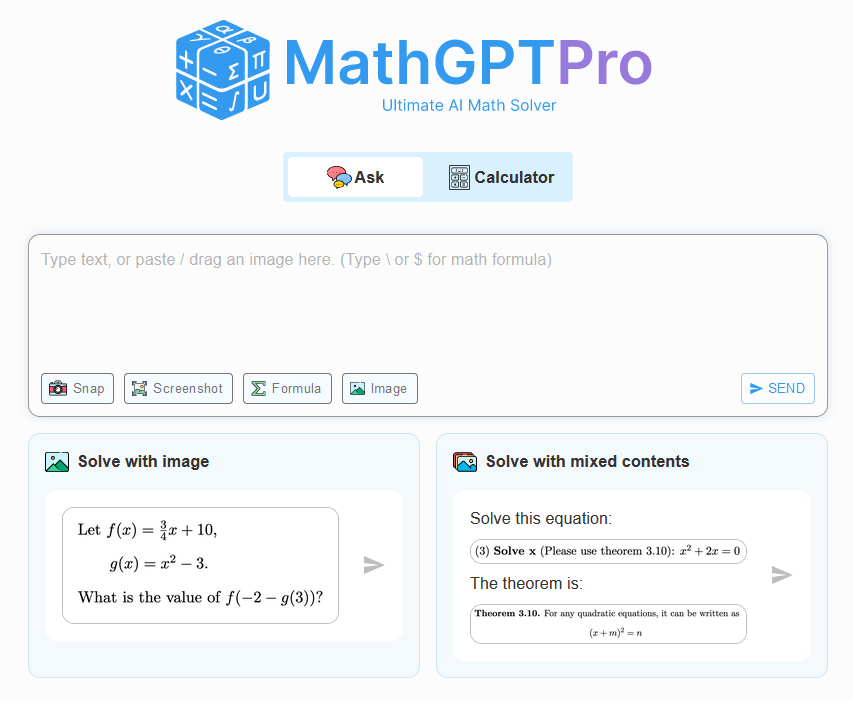

Nogle lærere er bekymrede for, at eleverne ikke udvikler deres skrivefærdigheder, fordi KI vil gøre arbejdet for dem. En lignende situation opstod i 1970'erne og 1980'erne, da elektroniske lommeregnere blev udbredt. Matematiklærerne var bekymrede for, at eleverne ikke længere ville lære grundlæggende aritmetik.

Der har altid været modstandere af fremskridt. For tusinder af år siden, i det gamle Grækenland, talte Sokrates imod selve skriften:

[Skrivning] vil skabe glemsomhed i elevernes sjæle, fordi de ikke vil bruge deres hukommelse; de vil stole på de eksterne skrevne tegn og ikke huske af sig selv. Det specifikke, som du har opdaget, er ikke en hjælp til hukommelse, men til reminiscens, og du giver ikke dine disciple sandhed, men kun skinnet af sandhed; de vil være tilhørere til mange ting og vil ikke have lært noget; de vil synes at være alvidende og vil generelt ikke vide noget; de vil være trættende selskab, der har visdomens show uden virkeligheden.

Jeg er ikke så gammel, at jeg kan huske det antikke Grækenland, men min matematiklærer plejede at sige: "Du vil ikke altid have en lommeregner i lommen." Og ved du hvad? Jeg har en lommeregner i lommen. Det er en applikation på min telefon.

Fremskridt kan ikke stoppes. Før eller siden bliver folk nødt til at tage teknologier baseret på kunstig intelligens til sig. KI vil blive et lige så almindeligt værktøj som en lommeregner.

MathGPT Pro

På dette tidspunkt skal vi huske, at chatbots er ufuldkomne og tilbøjelige til at hallucinere, og at de oplysninger, der genereres, skal kontrolleres omhyggeligt for nøjagtighed. Men at arbejde med kilder og dobbelttjekke fakta er helt almindeligt i uddannelses- og forskningsarbejde. Og med tiden vil chatbots blive bedre og mere pålidelige - det kan vi se i udviklingen af ChatGPT, fra GPT-2 til GPT-4.

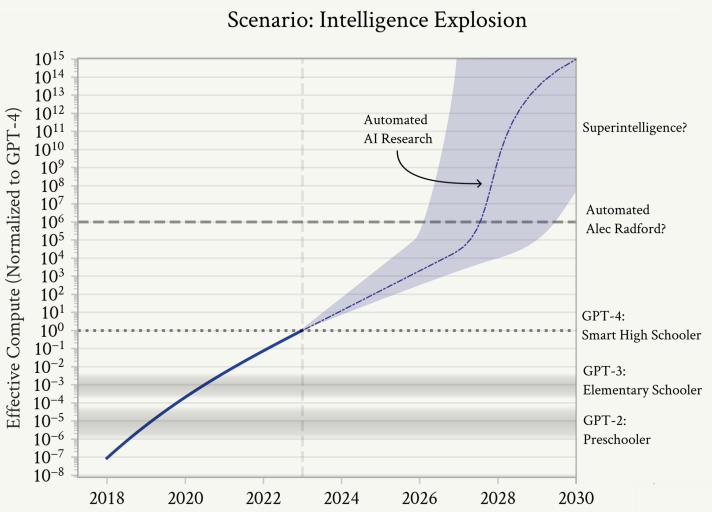

Skalerbart tilsyn

Efterhånden som KI-systemer bliver mere kraftfulde og komplekse, bliver det mere og mere udfordrende at kontrollere dem gennem menneskelig feedback. Det kan være langsomt eller umuligt for mennesker at evaluere kompleks KI-adfærd, især når KI overgår mennesker i et givet domæne. For at opdage, når AI'ens output er fejlagtigt overbevisende, har mennesker brug for hjælp eller lang tid. Skalerbart tilsyn kan reducere den tid og indsats, der er nødvendig for overvågning.

Ifølge Nick Bostrom kan udviklingen af superintelligens potentielt afbøde de eksistentielle risici, som andre avancerede teknologier som molekylær nanoteknologi eller syntetisk biologi udgør. At prioritere skabelsen af superintelligens før andre potentielt farlige teknologier kan således sænke den samlede eksistentielle risiko.

At udvikle superintelligens til at overvåge almindelig KI kan virke som at sætte vognen foran hesten, men superintelligens er måske ikke langt væk. Ifølge "Situational Awareness" af Leopold Aschenbrenner kan vi se superintelligens inden for 10 år fra nu.

Eksplosion af kunstig intelligens

Før vi ved af det, har vi superintelligens - KI-systemer, der er meget klogere end mennesker, og som er i stand til at udvise ny, kreativ og kompliceret adfærd, som vi slet ikke kan forstå - måske endda en lille civilisation bestående af milliarder af dem. Deres magt ville også være enorm. Ved at anvende superintelligens på forskning og udvikling inden for andre områder ville de eksplosive fremskridt ikke kun omfatte forskning i maskinlæring; snart ville de løse robotteknologi, tage dramatiske spring på tværs af andre videnskabelige og teknologiske områder inden for få år, og en industriel eksplosion ville følge. Superintelligens vil sandsynligvis give en afgørende militær fordel og udfolde uanede ødelæggelseskræfter. Vi vil stå over for et af de mest intense og ustabile øjeblikke i menneskehedens historie.