Διαχείριση των κινδύνων της τεχνητής νοημοσύνης για ένα ασφαλέστερο μέλλον

Οι τεχνολογίες που βασίζονται στην τεχνητή νοημοσύνη εισέρχονται γρήγορα σε όλες τις πτυχές της ζωής: ιατρική, εκπαίδευση, χρηματοοικονομικά, μέσα κοινωνικής δικτύωσης, αυτόνομα οχήματα, προγραμματισμός κ.λπ. Η πρόοδος δεν μπορεί να ανακοπεί, οπότε ο αντίκτυπος της τεχνητής νοημοσύνης θα συνεχίσει να επεκτείνεται κάθε χρόνο. Στο προηγούμενο άρθρο μας εξετάσαμε τους κινδύνους της τεχνητής νοημοσύνης και τώρα θα διερευνήσουμε πώς μπορούν να μειωθούν οι αρνητικοί παράγοντες που σχετίζονται με τη χρήση της ΤΝ.

Εργαλεία ανίχνευσης τεχνητής νοημοσύνης

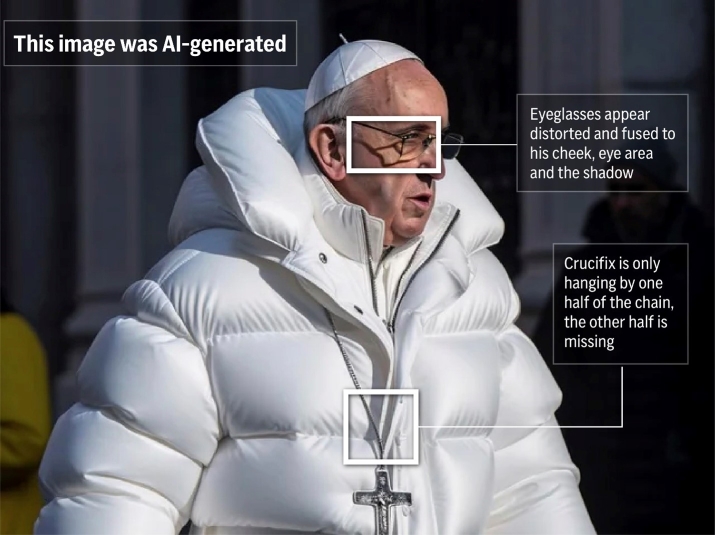

Με τη βοήθεια των σύγχρονων τεχνολογιών, είναι δυνατή η κατασκευή ήχου, φωτογραφιών και βίντεο, η δημιουργία deepfakes, η χειραγώγηση της κοινής γνώμης, η μίμηση της φωνής άλλου ατόμου και η παραποίηση αποδεικτικών στοιχείων.

Οι ερευνητές εργάζονται τώρα πάνω σε τρόπους ανίχνευσης των πλαστογραφιών, που τους επιτρέπουν να προσδιορίσουν αν μια ηχογράφηση ή μια βιντεοσκόπηση έχει αλλοιωθεί ή έχει δημιουργηθεί εξ ολοκλήρου από τεχνητή νοημοσύνη.

Ανίχνευση παραγόμενων εικόνων

- Η Intel δημιούργησε την πρώτη πλατφόρμα ανίχνευσης ψεύτικων εικόνων σε πραγματικό χρόνο με βάση την τεχνολογία FakeCatcher. Η τεχνολογία χρησιμοποιεί τεχνικές απομακρυσμένης φωτοπληθυσμογραφίας για την ανάλυση της ανεπαίσθητης "ροής αίματος" στα εικονοστοιχεία μιας εικόνας. Τα σήματα από πολλαπλά καρέ υποβάλλονται σε επεξεργασία μέσω ενός ταξινομητή για να προσδιοριστεί αν το εν λόγω βίντεο είναι πραγματικό ή ψεύτικο.

- Η αμερικανική κυβερνητική υπηρεσία DARPA εργάζεται πάνω σε τεχνολογίες SemaFor (συντομογραφία των Semantic Forensics) που μπορούν να ανιχνεύσουν με ακρίβεια συνθετικές εικόνες που έχουν δημιουργηθεί τεχνητά.

Άλλωστε, υπάρχουν ήδη δεκάδες διαφορετικά εργαλεία που στοχεύουν στην ανίχνευση δημιουργημένων εικόνων και κειμένων.

Κριτική σκέψη

Η παραπληροφόρηση, η προπαγάνδα και οι διάφορες μέθοδοι εξαπάτησης υπήρχαν πολύ πριν από την εφεύρεση της τεχνητής νοημοσύνης. Ίσως εσείς ή κάποιος γνωστός σας να έχει γίνει στόχος απατεώνων. Ορισμένοι άνθρωποι εξαπατώνται εύκολα από συστήματα όπως το ηλεκτρονικό ταχυδρομείο κληρονομιάς του "Νιγηριανού πρίγκιπα", ενώ άλλοι είναι πιο επιφυλακτικοί και σκέφτονται κριτικά. Με την άνοδο της τεχνολογίας που μπορεί να χειραγωγήσει εικόνες, ήχο και βίντεο, πρέπει τώρα να είμαστε ακόμη πιο επιμελείς στον έλεγχο των γεγονότων.

Ο μελλοντολόγος Mark Ford δήλωσε: "Κανείς δεν ξέρει τι είναι πραγματικό και τι όχι. Έτσι, οδηγεί πραγματικά σε μια κατάσταση όπου κυριολεκτικά δεν μπορείτε να πιστέψετε τα ίδια σας τα μάτια και τα αυτιά- δεν μπορείτε να βασιστείτε σε αυτό που, ιστορικά, θεωρούσαμε ως τα καλύτερα δυνατά στοιχεία".

Η αντιμετώπιση της απάτης και της παραπληροφόρησης θα είναι μια κυκλική διαδικασία: καθώς εμφανίζονται νέοι τρόποι εντοπισμού της εξαπάτησης, άλλοι θα αναπτύσσουν τρόπους αντιμετώπισής τους, οδηγώντας στη δημιουργία ακόμη περισσότερων εγγυήσεων. Αν και μπορεί να μην προσφέρει πλήρη προστασία, δεν θα είμαστε ανυπεράσπιστοι.

Ψεύτικη φωτογραφία του Πάπα Φραγκίσκου

Δημιουργία νέων θέσεων εργασίας

Η ευρεία υιοθέτηση της τεχνητής νοημοσύνης συνοδεύεται από τον κίνδυνο απώλειας θέσεων εργασίας. Συζητήσαμε λεπτομερώς αυτό το πρόβλημα σε ένα από τα προηγούμενα άρθρα. Εκεί μπορείτε επίσης να βρείτε συνδέσμους σε μελέτες, να μάθετε ποια επαγγέλματα κινδυνεύουν περισσότερο και ποια όχι.

Φυσικά, πολλοί άνθρωποι θα χάσουν τη δουλειά τους λόγω της τεχνητής νοημοσύνης (σύμφωνα με διάφορες εκτιμήσεις, από 100 έως 800 εκατομμύρια άτομα), και κάποιοι θα πρέπει να υποβληθούν σε επαγγελματική επανεκπαίδευση (η Seo.ai υπολογίζει τον αριθμό τους σε 120 εκατομμύρια άτομα).

Ωστόσο, η τεχνητή νοημοσύνη δεν θα αφαιρέσει μόνο θέσεις εργασίας, αλλά θα δημιουργήσει και νέες. Επιπλέον, είναι πιθανό ένα σενάριο κατά το οποίο νέες θέσεις εργασίας εμφανίζονται ταχύτερα από ό,τι εξαφανίζονται οι παλιές. Δείτε τι γράφει σχετικά το Παγκόσμιο Οικονομικό Φόρουμ:

Αν και ο αριθμός των θέσεων εργασίας που θα καταστραφούν θα ξεπεραστεί από τον αριθμό των "θέσεων εργασίας του αύριο" που θα δημιουργηθούν, σε αντίθεση με τα προηγούμενα χρόνια, η δημιουργία θέσεων εργασίας επιβραδύνεται ενώ η καταστροφή θέσεων εργασίας επιταχύνεται. Με βάση αυτά τα στοιχεία, εκτιμούμε ότι μέχρι το 2025, 85 εκατομμύρια θέσεις εργασίας μπορεί να εκτοπιστούν από την αλλαγή στον καταμερισμό εργασίας μεταξύ ανθρώπων και μηχανών, ενώ 97 εκατομμύρια νέοι ρόλοι μπορεί να προκύψουν.

Μεταξύ αυτών των νέων θέσεων εργασίας είναι:

- Μηχανικοί μοντέλων και προτροπών ΤΝ

- Σχεδιαστές διεπαφής και αλληλεπίδρασης

- Δημιουργοί περιεχομένου τεχνητής νοημοσύνης

- Επιμελητές και εκπαιδευτές δεδομένων

- Ειδικοί δεοντολογίας και διακυβέρνησης

Μερικές από τις νέες θέσεις εργασίας

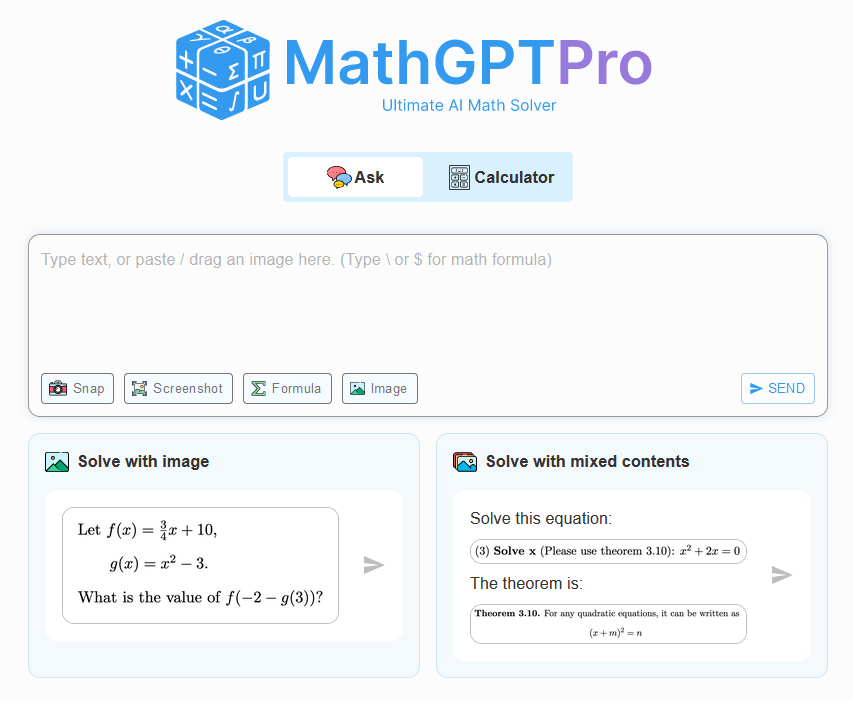

Αγκαλιάζοντας την τεχνολογία

Ορισμένοι εκπαιδευτικοί ανησυχούν ότι οι μαθητές μπορεί να μην αναπτύξουν τις δεξιότητες γραφής τους επειδή η ΤΝ θα κάνει τη δουλειά γι' αυτούς. Παρόμοια ήταν η κατάσταση στις δεκαετίες του 1970 και του 1980, όταν οι ηλεκτρονικές αριθμομηχανές έγιναν ευρέως διαδεδομένες. Οι καθηγητές μαθηματικών ανησυχούσαν ότι οι μαθητές δεν θα μάθαιναν πλέον τις βασικές αριθμητικές πράξεις.

Πάντα υπήρχαν αντίπαλοι της προόδου. Χιλιάδες χρόνια πριν, στην Αρχαία Ελλάδα, ο Σωκράτης μίλησε εναντίον της ίδιας της γραφής:

[Η γραφή] θα δημιουργήσει λήθη στις ψυχές των μαθητών, επειδή δεν θα χρησιμοποιούν τη μνήμη τους- θα εμπιστεύονται τους εξωτερικούς γραπτούς χαρακτήρες και δεν θα θυμούνται τον εαυτό τους. Το συγκεκριμένο που ανακαλύψατε είναι ένα βοήθημα όχι για τη μνήμη, αλλά για την ανάμνηση, και δίνετε στους μαθητές σας όχι την αλήθεια, αλλά μόνο την επίφαση της αλήθειας- θα είναι ακροατές πολλών πραγμάτων και δεν θα έχουν μάθει τίποτα- θα φαίνονται παντογνώστες και γενικά δεν θα γνωρίζουν τίποτα- θα είναι κουραστική παρέα, έχοντας την επίφαση της σοφίας χωρίς την πραγματικότητα.

Δεν είμαι τόσο αρχαίος ώστε να θυμάμαι την Αρχαία Ελλάδα, αλλά ο καθηγητής μου στα μαθηματικά συνήθιζε να λέει: "Δεν θα έχεις πάντα αριθμομηχανή στην τσέπη σου". Και μάντεψε τι; Έχω αριθμομηχανή στην τσέπη μου. Είναι μια εφαρμογή στο τηλέφωνό μου.

Η πρόοδος δεν μπορεί να σταματήσει. Αργά ή γρήγορα, οι άνθρωποι θα πρέπει να αγκαλιάσουν τις τεχνολογίες που βασίζονται στην τεχνητή νοημοσύνη. Η τεχνητή νοημοσύνη θα γίνει τόσο κοινό εργαλείο όσο και η αριθμομηχανή.

MathGPT Pro

Σε αυτό το σημείο, πρέπει να θυμόμαστε ότι τα chatbots είναι ατελή, επιρρεπή σε ψευδαισθήσεις και οι πληροφορίες που παράγονται πρέπει να ελέγχονται προσεκτικά για την ακρίβειά τους. Ωστόσο, η εργασία με πηγές και ο διπλός έλεγχος των γεγονότων είναι κάτι συνηθισμένο στην εκπαιδευτική ή ερευνητική εργασία. Και με την πάροδο του χρόνου, τα chatbots θα γίνουν καλύτερα και πιο αξιόπιστα - μπορούμε να το δούμε αυτό στην εξέλιξη του ChatGPT, από το GPT-2 στο GPT-4.

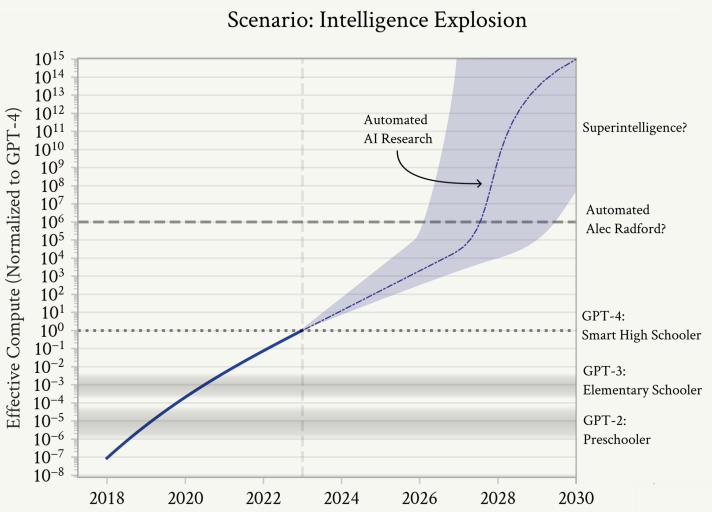

Επεκτάσιμη εποπτεία

Καθώς τα συστήματα τεχνητής νοημοσύνης γίνονται όλο και πιο ισχυρά και πολύπλοκα, γίνεται όλο και πιο δύσκολο να ελέγχονται μέσω ανθρώπινης ανατροφοδότησης. Μπορεί να είναι αργό ή ανέφικτο για τον άνθρωπο να αξιολογήσει πολύπλοκες συμπεριφορές ΤΝ, ειδικά όταν η ΤΝ ξεπερνά τον άνθρωπο σε έναν συγκεκριμένο τομέα. Για να εντοπίσουν πότε η έξοδος της ΤΝ είναι ψευδώς πειστική, οι άνθρωποι χρειάζονται βοήθεια ή εκτεταμένο χρόνο. Η κλιμακούμενη εποπτεία μπορεί να μειώσει τον χρόνο και την προσπάθεια που απαιτούνται για την εποπτεία.

Σύμφωνα με τον Nick Bostrom, η ανάπτυξη της υπερ-νοημοσύνης θα μπορούσε ενδεχομένως να μετριάσει τους υπαρξιακούς κινδύνους που εγκυμονούν άλλες προηγμένες τεχνολογίες, όπως η μοριακή νανοτεχνολογία ή η συνθετική βιολογία. Έτσι, η ιεράρχηση της δημιουργίας της υπερ-νοημοσύνης πριν από άλλες δυνητικά επικίνδυνες τεχνολογίες θα μπορούσε να μειώσει τον συνολικό υπαρξιακό κίνδυνο.

Η ανάπτυξη υπερ-νοημοσύνης για την επίβλεψη της κανονικής ΤΝ μπορεί να φαίνεται σαν να βάζουμε το κάρο μπροστά από το άλογο, αλλά η υπερ-νοημοσύνη μπορεί να μην είναι μακριά. Σύμφωνα με το άρθρο "Situational Awareness" του Leopold Aschenbrenner θα μπορούσαμε να δούμε την υπερ-νοημοσύνη σε 10 χρόνια από τώρα.

Έκρηξη της τεχνητής νοημοσύνης

Πριν το καταλάβουμε, θα έχουμε στα χέρια μας υπερ-νοημοσύνη - συστήματα Τεχνητής Νοημοσύνης πολύ πιο έξυπνα από τους ανθρώπους, ικανά για νέες, δημιουργικές, περίπλοκες συμπεριφορές που δεν μπορούμε καν να κατανοήσουμε - ίσως ακόμη και έναν μικρό πολιτισμό δισεκατομμυρίων από αυτά. Η δύναμή τους θα ήταν επίσης τεράστια. Εφαρμόζοντας την υπερ-νοημοσύνη στην έρευνα και την ανάπτυξη σε άλλους τομείς, η εκρηκτική πρόοδος θα διευρυνόταν από την απλή έρευνα για τη μηχανική μάθηση- σύντομα θα έλυναν τη ρομποτική, θα έκαναν δραματικά άλματα σε άλλους τομείς της επιστήμης και της τεχνολογίας μέσα σε λίγα χρόνια, και θα ακολουθούσε μια βιομηχανική έκρηξη. Η υπερ-νοημοσύνη θα παρείχε πιθανότατα ένα αποφασιστικό στρατιωτικό πλεονέκτημα και θα ξεδίπλωνε ανείπωτες δυνάμεις καταστροφής. Θα βρεθούμε αντιμέτωποι με μια από τις πιο έντονες και ασταθείς στιγμές της ανθρώπινης ιστορίας.