Upravljanje rizicima umjetne inteligencije za sigurniju budućnost

Tehnologije temeljene na umjetnoj inteligenciji brzo se probijaju u sve aspekte života: medicinu, obrazovanje, financije, društvene medije, autonomna vozila, programiranje itd. Napredak se ne može zaustaviti, stoga će se utjecaj umjetne inteligencije svake godine samo povećavati. U našem prethodnom članku ispitali smo rizike umjetne inteligencije, a sada ćemo istražiti kako se mogu smanjiti negativni čimbenici povezani s upotrebom umjetne inteligencije.

Alati za otkrivanje umjetne inteligencije

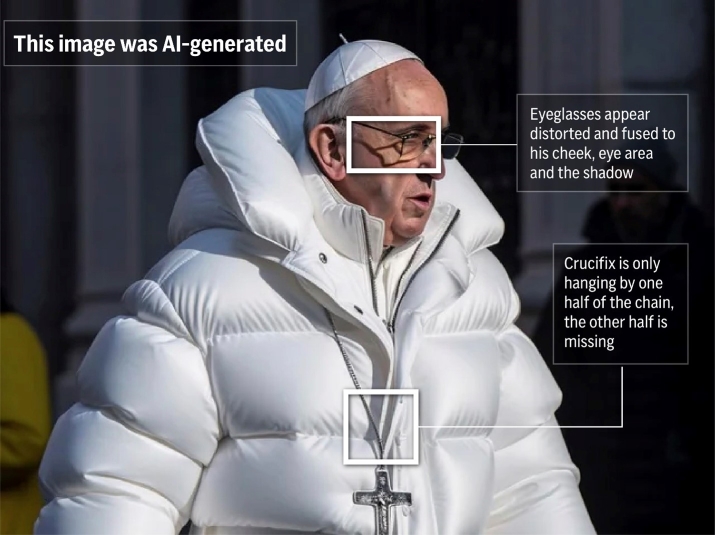

Uz pomoć suvremenih tehnologija moguće je izmišljati audio, fotografije i video zapise, stvarati deepfakeove, manipulirati javnim mnijenjem, oponašati tuđi glas i krivotvoriti dokaze.

Istraživači sada rade na načinima otkrivanja krivotvorina, što im omogućuje da utvrde je li audio ili video zapis izmijenjen ili ga je u potpunosti generirala umjetna inteligencija.

Otkrivanje generiranih slika

- Intel je stvorio prvu platformu za duboko otkrivanje krivotvorina u stvarnom vremenu temeljenu na tehnologiji FakeCatcher. Tehnologija koristi tehnike fotopletizmografije na daljinu za analizu suptilnog "protoka krvi" u pikselima slike. Signali iz više okvira obrađuju se kroz klasifikator kako bi se utvrdilo je li dotični video stvaran ili lažan.

- Američka vladina agencija DARPA radi na tehnologiji SemaFor (skraćeno od Semantic Forensics) koja može točno detektirati sintetičke umjetno generirane slike.

Osim toga, već postoje deseci različitih alata namijenjenih otkrivanju generiranih slika i teksta.

Kritičko razmišljanje

Dezinformacije, propaganda i razne metode prijevare postojale su puno prije izuma umjetne inteligencije. Možda ste vi ili netko koga poznajete bili meta prevaranata. Neke ljude je lako prevariti shemama kao što je e-mail o nasljedstvu "nigerijskog princa", dok su drugi skeptičniji i razmišljaju kritički. S porastom tehnologije koja može manipulirati slikama, zvukom i videom, sada moramo biti još revniji u provjeri činjenica.

Futurist Mark Ford je rekao: “Nitko ne zna što je stvarno, a što nije. Dakle, to stvarno dovodi do situacije u kojoj doslovno ne možete vjerovati vlastitim očima i ušima; ne možete se osloniti na ono što smo, povijesno gledano, smatrali najboljim mogućim dokazom.”

Suprotstavljanje prijevarama i dezinformacijama bit će ciklički proces: kako se budu pojavljivali novi načini za otkrivanje prijevara, drugi će razviti načine za suprotstavljanje njima, što će dovesti do stvaranja još više zaštitnih mjera. Iako možda ne nudi potpunu zaštitu, nećemo biti bespomoćni.

Lažna fotografija pape Franje

Otvaranje novih radnih mjesta

Široko usvajanje umjetne inteligencije nosi rizik gubitka posla. O ovom smo problemu detaljno raspravljali u jednom od prethodnih članaka. Tamo možete pronaći i poveznice na studije, saznati koja su zanimanja najugroženija, a koja nisu.

Naravno, mnogi će ljudi zbog umjetne inteligencije ostati bez posla (prema različitim procjenama od 100 do 800 milijuna ljudi), a neki će morati na profesionalnu prekvalifikaciju (Seo.ai njihov broj procjenjuje na 120 milijuna ljudi).

Međutim, umjetna inteligencija neće samo oduzeti radna mjesta, već i stvoriti nova. Štoviše, moguć je scenarij kada se nova radna mjesta pojavljuju brže nego stara nestaju. Evo što o tome piše Svjetski ekonomski forum:

Iako će broj ugašenih radnih mjesta biti nadmašen brojem stvorenih 'radnih mjesta sutrašnjice', za razliku od prethodnih godina, otvaranje radnih mjesta usporava, a gašenje se ubrzava. Na temelju ovih brojki procjenjujemo da bi do 2025. 85 milijuna radnih mjesta moglo biti premješteno pomakom u podjeli rada između ljudi i strojeva, dok bi se moglo pojaviti 97 milijuna novih uloga.

Među novim poslovima koji se otvaraju su:

- Model umjetne inteligencije i prompt inženjeri

- Dizajneri sučelja i interakcija

- Kreatori sadržaja s umjetnom inteligencijom

- Kustosi podataka i treneri

- Stručnjaci za etiku i upravljanje

Neki od novih poslova

Prihvaćanje tehnologije

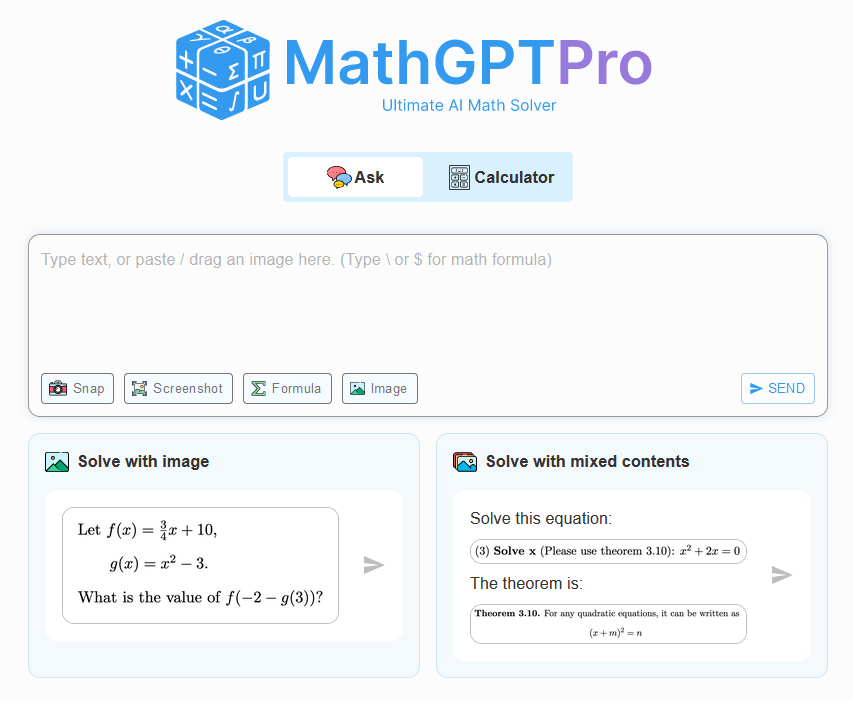

Neki su učitelji zabrinuti da učenici možda neće razviti svoje vještine pisanja jer će umjetna inteligencija obaviti posao umjesto njih. Slična situacija bila je 1970-ih i 1980-ih, kada su elektronički kalkulatori postali široko rasprostranjeni. Učitelji matematike brinuli su se da učenici više neće učiti osnovnu aritmetiku.

Uvijek je bilo protivnika napretka. Prije nekoliko tisuća godina, u staroj Grčkoj, Sokrat je govorio protiv samog pisanja:

[Pisanje] će stvoriti zaborav u dušama učenika, jer oni neće koristiti svoja sjećanja; vjerovat će vanjskim pisanim znakovima i neće se sjećati sebe. Specifičnost koju ste otkrili nije pomoć pamćenju, već reminiscenciji, a vi svojim učenicima ne dajete istinu, već samo privid istine; oni će biti slušatelji mnogih stvari, a neće naučiti ništa; činit će se sveznajućima i općenito neće ništa znati; oni će biti dosadno društvo, koje će pokazati mudrost bez stvarnosti.

Nisam tako star da se sjećam antičke Grčke, ali moj profesor matematike govorio je: "Nećete uvijek imati kalkulator u džepu." I pogodi što? Imam kalkulator u džepu. To je aplikacija na mom telefonu.

Napredak se ne može zaustaviti. Prije ili kasnije, ljudi će morati prihvatiti tehnologije koje se temelje na umjetnoj inteligenciji. Umjetna inteligencija postat će uobičajen alat kao kalkulator.

MathGPT Pro

U ovom trenutku moramo zapamtiti da su chatbotovi nesavršeni, skloni halucinacijama, a generirane informacije moraju biti pažljivo provjerene radi točnosti. Međutim, rad s izvorima i dvostruka provjera činjenica uobičajeni su u obrazovnom ili istraživačkom radu. S vremenom će chatbotovi postati bolji i pouzdaniji – to možemo vidjeti u evoluciji ChatGPT-a, od GPT-2 do GPT-4.

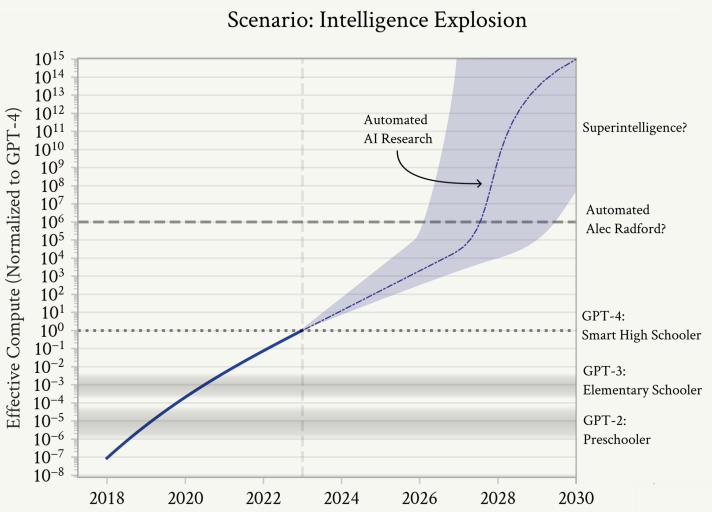

Skalabilni nadzor

Kako AI sustavi postaju moćniji i složeniji, postaje sve veći izazov kontrolirati ih putem ljudskih povratnih informacija. Ljudima može biti sporo ili neizvedivo da procijene složena ponašanja umjetne inteligencije, osobito kada umjetna inteligencija nadmašuje ljude u određenoj domeni. Kako bi otkrili kada je rezultat umjetne inteligencije lažno uvjerljiv, ljudima je potrebna pomoć ili puno vremena. Skalabilni nadzor može smanjiti vrijeme i trud potreban za nadzor.

Prema Nicku Bostromu, razvoj superinteligencije mogao bi potencijalno ublažiti egzistencijalne rizike koje nose druge napredne tehnologije poput molekularne nanotehnologije ili sintetičke biologije. Stoga bi davanje prioriteta stvaranju superinteligencije prije drugih potencijalno opasnih tehnologija moglo smanjiti ukupni egzistencijalni rizik.

Razvijanje superinteligencije za nadzor obične umjetne inteligencije može se činiti kao stavljanje kola ispred konja, ali superinteligencija možda nije daleko. Prema “Situacijskoj svjesnosti” Leopolda Aschenbrennera, mogli bismo vidjeti superinteligenciju u roku od 10 godina od sada.

Eksplozija umjetne inteligencije

Prije nego što to shvatimo, imali bismo superinteligenciju u našim rukama - sustave umjetne inteligencije znatno pametnije od ljudi, sposobne za novo, kreativno, komplicirano ponašanje koje ne bismo mogli ni razumjeti - možda čak i malu civilizaciju od milijardi njih. Njihova bi moć također bila golema. Primjenom superinteligencije na istraživanje i razvoj u drugim poljima, eksplozivan napredak proširio bi se od samo istraživanja strojnog učenja; uskoro bi riješili robotiku, napravili dramatične skokove u drugim područjima znanosti i tehnologije u roku od nekoliko godina, a uslijedila bi industrijska eksplozija. Superinteligencija bi vjerojatno osigurala odlučujuću vojnu prednost i razotkrila neizrecive moći razaranja. Bit ćemo suočeni s jednim od najintenzivnijih i najnestabilnijih trenutaka ljudske povijesti.