より安全な未来のために人工知能のリスクを管理する

人工知能に基づくテクノロジーは、医療、教育、金融、ソーシャルメディア、自律走行車、プログラミングなど、生活のあらゆる側面に急速に浸透している。進歩を止めることはできないので、AIの影響は年々拡大し続けるだろう。前回は人工知能のリスクについて考察したが、今回はAIの使用に伴うマイナス要因をどのように軽減できるかを探ってみたい。

AI検知ツール

現代のテクノロジーを使えば、音声や写真、動画を捏造したり、ディープフェイクを作ったり、世論を操作したり、他人の声を真似たり、証拠を改ざんしたりすることが可能だ。

研究者たちは現在、捏造を検出する方法に取り組んでおり、音声やビデオ録画が改ざんされたものなのか、それとも完全に人工知能によって生成されたものなのかを判断できるようにしている。

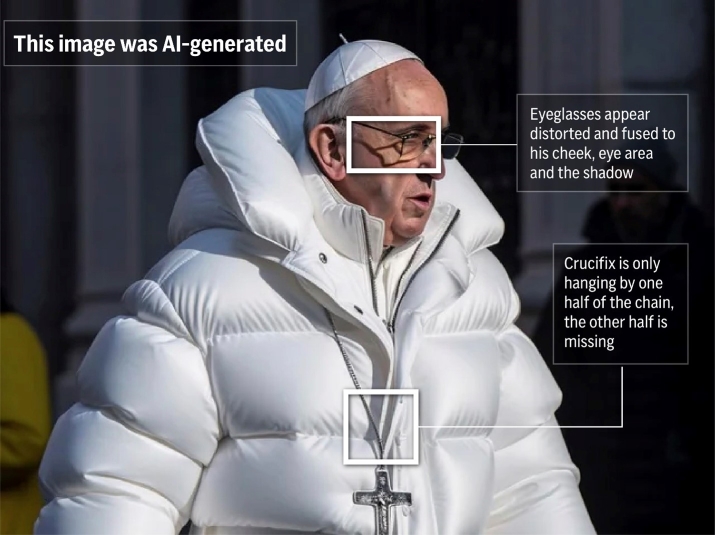

生成画像の検出

- インテルは、FakeCatcher技術に基づく史上初のリアルタイム・ディープフェイク検知プラットフォームを開発した。この技術は、遠隔光電脈波技術を使用して、画像のピクセル内の微妙な「血流」を分析する。複数のフレームからの信号を分類器を通して処理し、問題の映像が本物か偽物かを判定する。

- 米政府機関DARPAは、人工的に生成された合成画像を正確に検出できるSemaFor技術(Semantic Forensicsの略)に取り組んでいる。

そのほか、生成された画像やテキストを検出することを目的としたツールはすでに何十種類もある。

批判的思考

偽情報、プロパガンダ、さまざまな欺瞞の手法は、人工知能が発明されるずっと以前から存在していた。もしかしたら、あなたやあなたの知り合いが詐欺師に狙われたことがあるかもしれない。ナイジェリアの王子様」と呼ばれる遺産相続メールのような手口に簡単に騙される人もいれば、懐疑的で批判的に考える人もいる。画像、音声、動画を操作できる技術が台頭している今、私たちは事実確認にさらに精を出さなければならない。

未来学者のマーク・フォードは言う: 「何が本当で何が嘘なのか、誰にもわからない。つまり、文字通り自分の目や耳を信じることができない状況に陥っているのだ。

詐欺や誤報に対抗するのは、循環的なプロセスである。欺瞞を発見する新しい方法が出現すれば、それに対抗する方法も開発され、さらに多くの安全策が生み出されることになる。完全な保護はできないかもしれないが、無防備になることはないだろう。

フランシスコ法王の偽写真

新たな雇用の創出

人工知能の普及には雇用喪失のリスクが伴う。この問題については、以前の記事で詳しく説明した。そこには研究へのリンクもあり、どの職業が最もリスクが高く、どの職業はリスクがないかを知ることができる。

もちろん、人工知能によって多くの人が職を失い(様々な試算によると、1億人から8億人)、専門的な再教育を受けなければならない人も出てくるだろう(Seo.aiはその数を1億2000万人と見積もっている)。

しかし、AIは仕事を奪うだけでなく、新たな仕事を生み出す。さらに、古い仕事がなくなるよりも、新しい仕事が生まれる方が早いというシナリオもあり得る。世界経済フォーラムはこのように書いている:

破壊される雇用の数は、創出される「明日の雇用」の数を上回るだろうが、これまでとは対照的に、雇用創出は減速している一方で、雇用破壊は加速している。これらの数字に基づき、私たちは2025年までに8500万人の雇用が人間と機械の分業化によって失われ、9700万人の新しい役割が生まれると推定している。

そのような新しい仕事の中には、以下のようなものがある:

- AIモデルとプロンプトエンジニア

- インターフェイス・インタラクションデザイナー

- AIコンテンツクリエーター

- データキュレーターとトレーナー

- 倫理とガバナンスのスペシャリスト

新しい仕事の一部

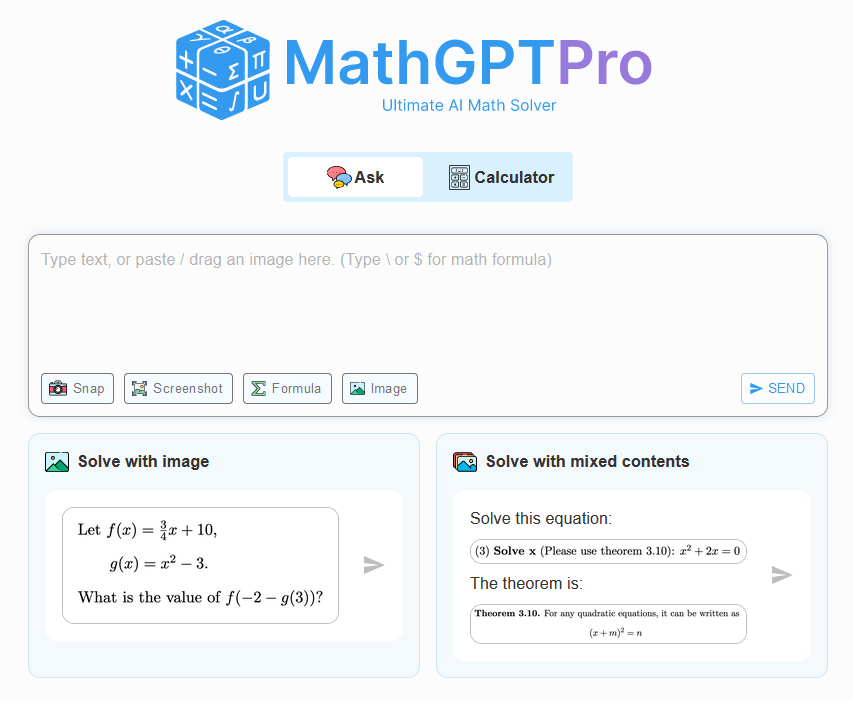

テクノロジーを受け入れる

一部の教師は、AIが代わりに仕事をしてくれるから、生徒が文章を書く能力を伸ばさないのではないかと懸念している。似たような状況は、電子計算機が普及した1970年代と1980年代にもあった。数学の教師たちは、生徒たちが基本的な算数を学ばなくなるのではないかと心配した。

進歩に反対する人々は常に存在した。何千年も前の古代ギリシャでは、ソクラテスが文字を書くこと自体に反対していた:

書くことは、学習者の魂に忘却を生み出す。なぜなら、彼らは記憶を使わないからである。彼らは外部に書かれた文字を信頼し、自分自身のことを思い出さない。あなた方が発見した具体的な方法は、記憶ではなく追憶を助けるものであり、あなた方は弟子たちに真理を与えるのではなく、真理の見せかけを与えるだけだ。

私は古代ギリシャを覚えているほど古くはないが、数学の先生はよく "いつもポケットに電卓があるとは限らない "と言っていた。そして何だと思う?私はポケットに電卓を入れている。携帯電話のアプリケーションだ。

進歩は止められない。遅かれ早かれ、人々は人工知能ベースの技術を受け入れなければならなくなるだろう。AIは電卓と同じくらい一般的なツールになるだろう。

MathGPT Pro

この時点で、チャットボットは不完全であり、幻覚を見やすく、生成された情報の正確性を注意深くチェックする必要があることを忘れてはならない。しかし、情報源と協力して事実をダブルチェックすることは、教育や研究の仕事では当たり前のことだ。そして時間が経つにつれて、チャットボットはより良く、より信頼できるようになるでしょう。これはGPT-2からGPT-4へのChatGPTの進化を見ればわかります。

スケーラブルな監督

AIシステムがより強力で複雑になるにつれて、人間のフィードバックによってそれらを制御することがますます難しくなっている。複雑なAIの行動を人間が評価するのは、時間がかかったり、実行不可能だったりする。AIの出力が誤って説得力のあるものであることを検知するためには、人間は支援や膨大な時間を必要とする。スケーラブルな監視は、監視に必要な時間と労力を削減することができる。

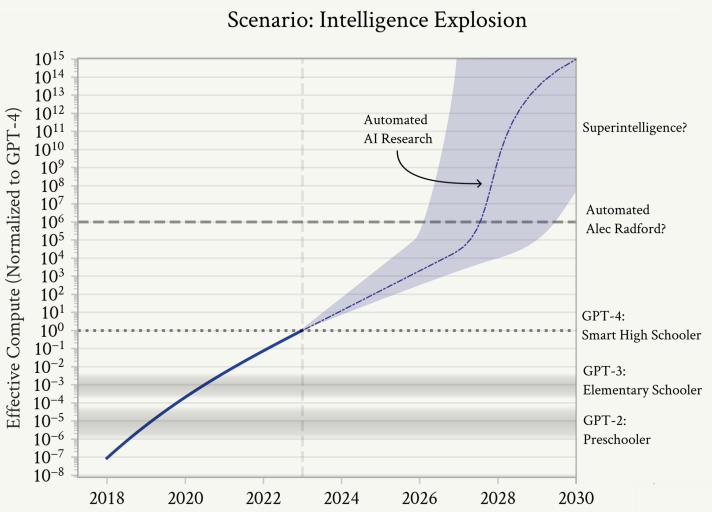

ニック・ボストロムによれば、超知能の開発は、分子ナノテクノロジーや合成生物学のような他の先端技術がもたらす存亡の危機を軽減する可能性があるという。したがって、他の潜在的に危険な技術よりも先に超知能の創造を優先させることで、全体的な存立リスクを低下させることができる。

通常のAIを監督する超知能を開発することは、本末転倒のように思えるかもしれないが、超知能が実現する日はそう遠くないかもしれない。レオポルド・アッシェンブレナー著の『状況認識』によれば、我々は今から10年以内に超知能を目にすることができるだろう。

人工知能の爆発

私たちが知らないうちに、私たちは超知性を手にすることになるだろう。人間よりもはるかに賢いAIシステムは、私たちが理解できないような斬新で創造的で複雑な行動をとることができる。その力も莫大なものになるだろう。超知能を他分野の研究開発に応用すれば、爆発的な進歩は機械学習の研究だけにとどまらず、やがてロボット工学を解決し、数年以内に科学技術の他分野で劇的な飛躍を遂げ、産業が爆発的に発展するだろう。超知能はおそらく決定的な軍事的優位性をもたらし、計り知れない破壊力を展開するだろう。私たちは、人類史上最も激しく不安定な瞬間に直面することになるだろう。