Håndtering av risikoene ved kunstig intelligens for en tryggere fremtid

Teknologier basert på kunstig intelligens er på full fart inn i alle aspekter av livet: medisin, utdanning, finans, sosiale medier, selvkjørende kjøretøy, programmering osv. Utviklingen kan ikke stoppes, så effekten av kunstig intelligens vil bare fortsette å øke for hvert år som går. I vår forrige artikkel så vi nærmere på risikoen ved kunstig intelligens, og nå skal vi se nærmere på hvordan de negative faktorene knyttet til bruken av kunstig intelligens kan reduseres.

Verktøy for å oppdage KI

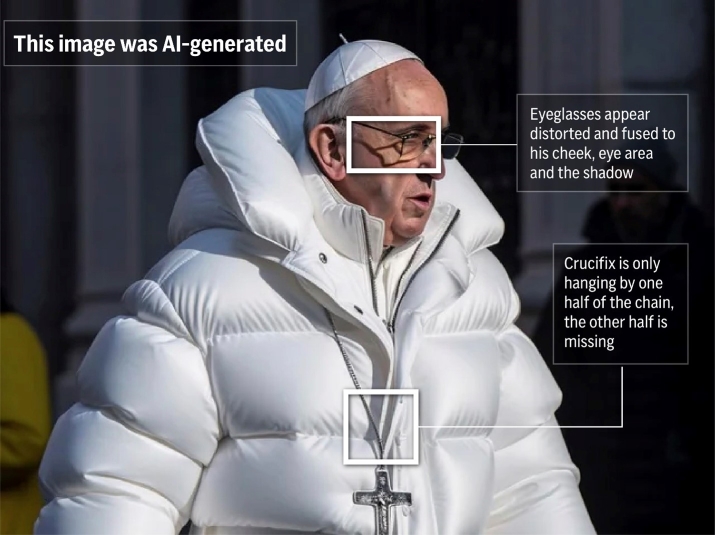

Ved hjelp av moderne teknologi er det mulig å fabrikkere lyd, bilder og videoer, lage deepfakes, manipulere opinionen, imitere en annen persons stemme og forfalske bevismateriale.

Forskere jobber nå med å finne måter å oppdage forfalskninger på, slik at de kan avgjøre om et lyd- eller videoopptak er endret eller helt og holdent generert av kunstig intelligens.

Detektering av genererte bilder

- Intel har utviklet den aller første plattformen for deepfake-deteksjon i sanntid basert på FakeCatcher-teknologi. Teknologien bruker fjernstyrte fotopletysmografiteknikker for å analysere den subtile "blodstrømmen" i pikslene i et bilde. Signalene fra flere bilder behandles gjennom en klassifiseringsenhet for å avgjøre om den aktuelle videoen er ekte eller falsk.

- Det amerikanske myndighetsorganet DARPA arbeider med SemaFor-teknologier (forkortelse for Semantic Forensics) som kan oppdage syntetiske, kunstig genererte bilder med stor nøyaktighet.

Dessuten finnes det allerede dusinvis av ulike verktøy som tar sikte på å oppdage genererte bilder og tekst.

Kritisk tenkning

Desinformasjon, propaganda og ulike former for bedrag har eksistert lenge før kunstig intelligens ble oppfunnet. Kanskje har du eller noen du kjenner blitt utsatt for svindlere. Noen lar seg lett lure av svindelforsøk som "nigerianerprinsen", mens andre er mer skeptiske og tenker kritisk. Med fremveksten av teknologi som kan manipulere bilder, lyd og video, må vi nå være enda mer påpasselige med faktasjekken.

Fremtidsforskeren Mark Ford sa "Ingen vet hva som er virkelig og hva som ikke er det. Så det fører til en situasjon der du bokstavelig talt ikke kan tro dine egne øyne og ører; du kan ikke stole på det vi historisk sett har ansett for å være de best mulige bevisene."

Å motvirke svindel og feilinformasjon vil være en syklisk prosess: Etter hvert som det dukker opp nye måter å oppdage svindel på, vil andre utvikle måter å motvirke dem på, noe som fører til at det opprettes enda flere sikkerhetstiltak. Selv om det kanskje ikke gir fullstendig beskyttelse, vil vi ikke være forsvarsløse.

Falsk bilde av pave Frans

Skaper nye arbeidsplasser

Utbredt bruk av kunstig intelligens innebærer en risiko for tap av arbeidsplasser. Vi har diskutert dette problemet i detalj i en av de tidligere artiklene. Der kan du også finne lenker til studier, finne ut hvilke yrker som er mest utsatt og hvilke som ikke er i faresonen.

Selvfølgelig vil mange mennesker miste jobben på grunn av kunstig intelligens (ifølge ulike estimater, fra 100 til 800 millioner mennesker), og noen vil måtte gjennomgå profesjonell omskolering (Seo.ai anslår antallet til 120 millioner mennesker).

Kunstig intelligens vil imidlertid ikke bare fjerne jobber, men også skape nye. Dessuten er det mulig at nye jobber dukker opp raskere enn de gamle forsvinner. Her er hva World Economic Forum skriver om det:

Selv om antallet jobber som forsvinner, vil bli overgått av antallet "morgendagens jobber" som skapes, er det i motsetning til tidligere år en nedgang i jobbskapingen, mens jobbødeleggelsen akselererer. Basert på disse tallene anslår vi at 85 millioner jobber kan bli fortrengt av en endret arbeidsdeling mellom mennesker og maskiner innen 2025, mens 97 millioner nye roller kan dukke opp.

Blant de nye jobbene som dukker opp, er:

- KI-modell- og Prompt-ingeniører

- Grensesnitt- og interaksjonsdesignere

- Skapere av KI-innhold

- Datakuratorer og undervisere

- Etikk- og styringsspesialister

Noen av de nye jobbene

Å omfavne teknologien

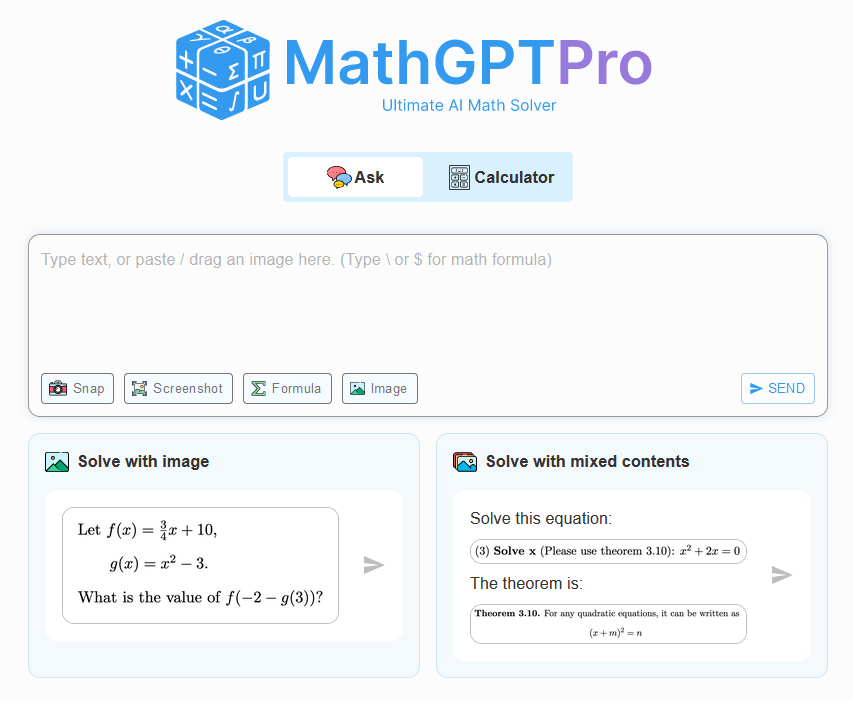

Noen lærere er bekymret for at elevene ikke skal utvikle skriveferdighetene sine fordi KI vil gjøre jobben for dem. En lignende situasjon oppstod på 1970- og 1980-tallet, da elektroniske kalkulatorer ble utbredt. Matematikklærerne var bekymret for at elevene ikke lenger ville lære seg grunnleggende aritmetikk.

Det har alltid vært motstandere av fremskrittet. For tusenvis av år siden, i antikkens Hellas, talte Sokrates mot selve skriften:

Skriving vil skape glemsel i elevenes sjeler, fordi de ikke vil bruke minnene sine; de vil stole på de ytre skrevne tegn og ikke huske av seg selv. Det spesifikke som du har oppdaget, er ikke et hjelpemiddel for hukommelsen, men for erindringen, og du gir ikke dine disipler sannhet, men bare et skinn av sannhet; de vil være tilhørere av mange ting og vil ikke ha lært noe; de vil se ut som om de er allvitende og vil generelt ikke vite noe; de vil være et slitsomt selskap, de vil ha et skinn av visdom uten å være det i virkeligheten.

Jeg er ikke så gammel at jeg husker antikkens Hellas, men mattelæreren min pleide å si: "Du vil ikke alltid ha en kalkulator i lommen." Og gjett hva? Jeg har en kalkulator i lommen. Det er en applikasjon på telefonen min.

Fremskrittet kan ikke stoppes. Før eller siden vil folk bli nødt til å omfavne teknologi basert på kunstig intelligens. KI vil bli et like vanlig verktøy som en kalkulator.

MathGPT Pro

Her må vi huske på at chatboter er ufullkomne, at de kan hallusinere, og at informasjonen som genereres, må sjekkes nøye for å sikre at den er korrekt. Å jobbe med kilder og dobbeltsjekke fakta er imidlertid vanlig i utdannings- og forskningsarbeid. Og over tid vil chatbotene bli bedre og mer pålitelige - det kan vi se i utviklingen av ChatGPT, fra GPT-2 til GPT-4.

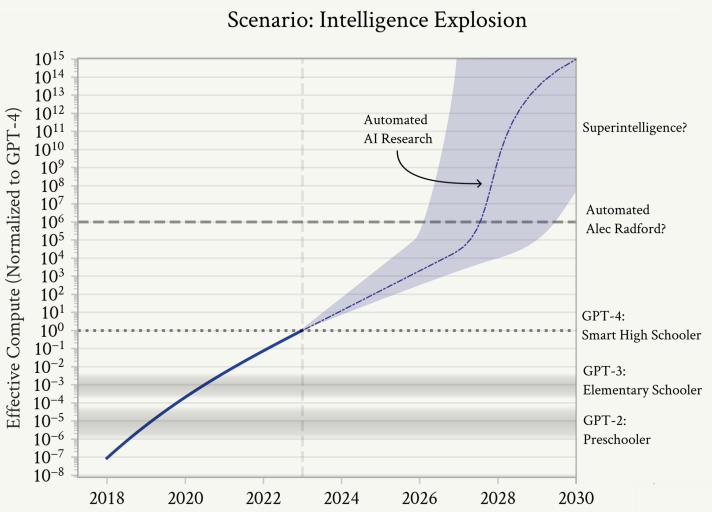

Skalerbart tilsyn

Etter hvert som KI-systemene blir kraftigere og mer komplekse, blir det stadig mer utfordrende å kontrollere dem gjennom menneskelige tilbakemeldinger. Det kan ta lang tid eller være umulig for mennesker å evaluere kompleks KI-atferd, spesielt når KI utkonkurrerer mennesker i et gitt domene. For å oppdage når den kunstige intelligensen gir feilaktig overbevisende resultater, trenger mennesker assistanse eller mye tid. Skalerbart tilsyn kan redusere tiden og innsatsen som trengs for tilsyn.

Ifølge Nick Bostrom kan utviklingen av superintelligens potensielt redusere de eksistensielle risikoene som andre avanserte teknologier, som molekylær nanoteknologi eller syntetisk biologi, utgjør. Ved å prioritere utviklingen av superintelligens før andre potensielt farlige teknologier kan man dermed redusere den samlede eksistensielle risikoen.

Å utvikle superintelligens for å overvåke vanlig KI kan virke som å sette vognen foran hesten, men superintelligens er kanskje ikke så langt unna. Ifølge "Situational Awareness" av Leopold Aschenbrenner kan vi se superintelligens innen 10 år fra nå.

Eksplosjonen av kunstig intelligens

Før vi vet ordet av det, vil vi ha superintelligens - KI-systemer som er mye smartere enn mennesker, i stand til ny, kreativ og komplisert atferd som vi ikke engang kan begynne å forstå - kanskje til og med en liten sivilisasjon bestående av milliarder av dem. Kraften deres ville også være enorm. Hvis superintelligens ble brukt i forskning og utvikling på andre områder, ville det føre til eksplosive fremskritt, ikke bare innen maskinlæring, men også innen robotikk og andre vitenskapelige og teknologiske områder, og en industriell eksplosjon ville følge i kjølvannet av dette. Superintelligens vil sannsynligvis gi en avgjørende militær fordel og utfolde uante ødeleggelseskrefter. Vi vil stå overfor et av de mest intense og ustabile øyeblikkene i menneskehetens historie.