De risico's van kunstmatige intelligentie beheren voor een veiligere toekomst

Technologieën gebaseerd op kunstmatige intelligentie vinden snel hun weg naar alle aspecten van het leven: geneeskunde, onderwijs, financiën, sociale media, autonome voertuigen, programmeren, enz. De vooruitgang is niet te stoppen, dus de impact van KI zal elk jaar alleen maar groter worden. In ons vorige artikel hebben we de risico's van kunstmatige intelligentie onderzocht, en nu zullen we onderzoeken hoe de negatieve factoren die samenhangen met het gebruik van KI kunnen worden verminderd.

Opsporingstools voor kunstmatige intelligentie

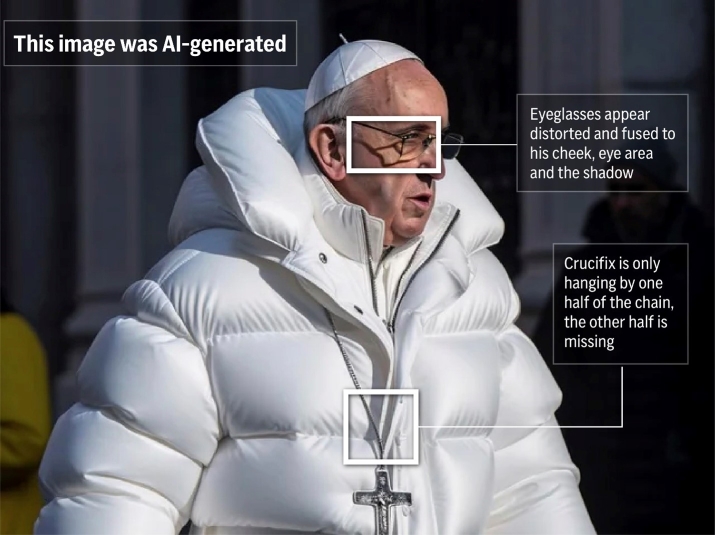

Met behulp van moderne technologieën is het mogelijk om audio, foto's en video's te vervalsen, deepfakes te maken, de publieke opinie te manipuleren, de stem van een ander na te bootsen en bewijsmateriaal te vervalsen.

Onderzoekers werken nu aan manieren om vervalsingen te detecteren, zodat ze kunnen bepalen of een audio- of video-opname is veranderd of volledig is gegenereerd door kunstmatige intelligentie.

Gegenereerde afbeeldingen detecteren

- Intel heeft het allereerste realtime deepfake detectieplatform gemaakt op basis van FakeCatcher-technologie. De technologie maakt gebruik van fotoplethysmografietechnieken op afstand om de subtiele "bloedstroom" in de pixels van een afbeelding te analyseren. De signalen van meerdere frames worden door een classifier verwerkt om te bepalen of de video in kwestie echt of nep is.

- De Amerikaanse overheidsinstelling DARPA werkt aan SemaFor-technologieën (kort voor Semantic Forensics) die synthetische, kunstmatig gegenereerde beelden nauwkeurig kunnen detecteren.

Daarnaast zijn er al tientallen verschillende tools om gegenereerde afbeeldingen en tekst te detecteren.

Kritisch denken

Desinformatie, propaganda en verschillende methoden van misleiding bestonden al lang voor de uitvinding van kunstmatige intelligentie. Misschien ben jij of iemand die je kent wel eens het doelwit geweest van oplichters. Sommige mensen laten zich gemakkelijk misleiden door oplichtingspraktijken zoals de "Nigeriaanse prins"-erfenismail, terwijl anderen sceptischer zijn en kritisch nadenken. Met de opkomst van technologie die afbeeldingen, audio en video kan manipuleren, moeten we nu nog ijveriger zijn in het controleren van feiten.

Futurist Mark Ford zei: "Niemand weet wat echt is en wat niet. Het leidt dus echt tot een situatie waarin je letterlijk je eigen ogen en oren niet kunt geloven; je kunt niet vertrouwen op wat we historisch gezien als het best mogelijke bewijs hebben beschouwd."

Het tegengaan van oplichterij en desinformatie zal een cyclisch proces zijn: naarmate er nieuwe manieren ontstaan om misleiding te detecteren, zullen anderen manieren ontwikkelen om deze tegen te gaan, wat leidt tot het creëren van nog meer beveiligingen. Hoewel het misschien geen volledige bescherming biedt, zullen we niet weerloos zijn.

Nepfoto van paus Franciscus

Nieuwe banen creëren

De wijdverspreide toepassing van kunstmatige intelligentie brengt het risico van banenverlies met zich mee. We hebben dit probleem in detail besproken in een van de vorige artikelen. Daar kun je ook links vinden naar studies, om te zien welke beroepen het meeste risico lopen en welke niet.

Natuurlijk zullen veel mensen hun baan verliezen door kunstmatige intelligentie (volgens verschillende schattingen tussen de 100 en 800 miljoen mensen), en sommigen zullen zich moeten laten omscholen (Seo.ai schat hun aantal op 120 miljoen mensen).

KI zal echter niet alleen banen wegnemen, maar ook nieuwe banen creëren. Bovendien is er een scenario mogelijk waarin nieuwe banen sneller verschijnen dan oude verdwijnen. Dit is wat het World Economic Forum erover schrijft:

Hoewel het aantal banen dat wordt vernietigd, zal worden overtroffen door het aantal 'banen van morgen' dat wordt gecreëerd, neemt het creëren van banen in tegenstelling tot voorgaande jaren af terwijl het vernietigen van banen versnelt. Op basis van deze cijfers schatten we dat er tegen 2025 85 miljoen banen kunnen verdwijnen door een verschuiving in de taakverdeling tussen mensen en machines, terwijl er 97 miljoen nieuwe functies kunnen ontstaan.

Onder deze opkomende nieuwe banen zijn:

- KI Model en Prompt Engineers

- Interface- en interactieontwerpers

- KI-inhoudsontwikkelaars

- Datacurators en -trainers

- Ethiek- en bestuursspecialisten

Enkele van de nieuwe banen

De technologie omarmen

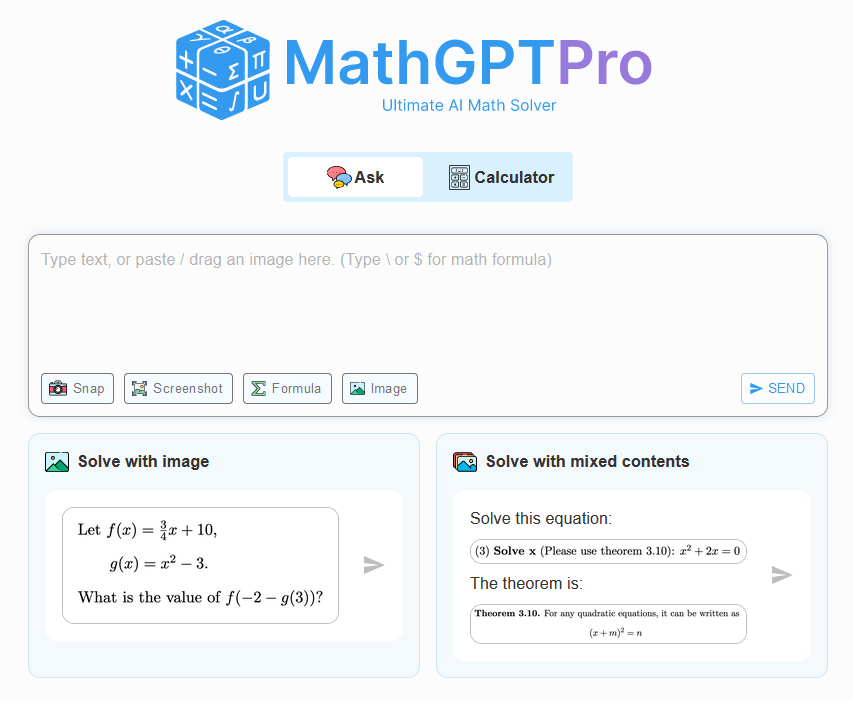

Sommige leerkrachten zijn bang dat leerlingen hun schrijfvaardigheid niet zullen ontwikkelen omdat KI het werk voor hen zal doen. Een soortgelijke situatie deed zich voor in de jaren 1970 en 1980, toen elektronische rekenmachines wijdverspreid werden. Wiskundedocenten maakten zich zorgen dat leerlingen niet meer zouden leren rekenen.

Er zijn altijd tegenstanders van vooruitgang geweest. Duizenden jaren geleden, in het oude Griekenland, sprak Socrates zich uit tegen het schrijven zelf:

Schrijven zal in de ziel van de leerlingen vergeetachtigheid teweegbrengen, omdat zij hun geheugen niet zullen gebruiken; zij zullen vertrouwen op de uiterlijke geschreven tekens en zich van zichzelf niets herinneren. Het specifieke dat jullie ontdekt hebben is geen hulpmiddel voor het geheugen, maar voor de herinnering, en jullie geven jullie leerlingen geen waarheid, maar slechts de schijn van waarheid; zij zullen van vele dingen horen en niets geleerd hebben; zij zullen alwetend lijken en over het algemeen niets weten; zij zullen vermoeiend gezelschap zijn, omdat zij de schijn van wijsheid hebben zonder de werkelijkheid.

Ik ben niet zo oud dat ik me het oude Griekenland nog kan herinneren, maar mijn wiskundeleraar zei altijd: "Je zult niet altijd een rekenmachine op zak hebben." En raad eens? Ik heb wel een rekenmachine in mijn zak. Het is een applicatie op mijn telefoon.

Vooruitgang is niet tegen te houden. Vroeg of laat zullen mensen op kunstmatige intelligentie gebaseerde technologieën moeten omarmen. KI zal net zo'n gewoon hulpmiddel worden als een rekenmachine.

MathGPT Pro

Op dit punt moeten we onthouden dat chatbots onvolmaakt zijn, vatbaar voor hallucinaties en dat de gegenereerde informatie zorgvuldig moet worden gecontroleerd op nauwkeurigheid. Het werken met bronnen en het dubbelchecken van feiten is echter heel gewoon in onderwijs- of onderzoekswerk. En na verloop van tijd zullen chatbots beter en betrouwbaarder worden - we kunnen dit zien in de evolutie van ChatGPT, van GPT-2 naar GPT-4.

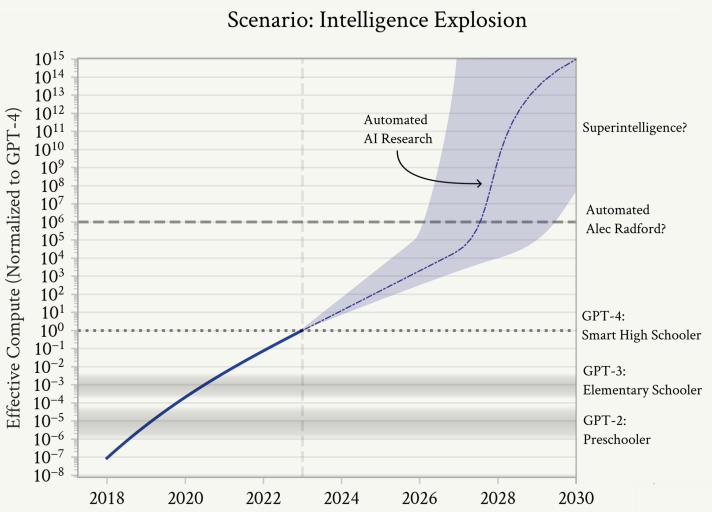

Schaalbaar toezicht

Naarmate KI-systemen krachtiger en complexer worden, wordt het steeds moeilijker om ze te controleren via menselijke feedback. Het kan langzaam of ondoenlijk zijn voor mensen om complex KI-gedrag te evalueren, vooral wanneer KI beter presteert dan mensen in een bepaald domein. Om te detecteren wanneer de output van de KI vals overtuigend is, hebben mensen hulp of veel tijd nodig. Schaalbaar toezicht kan de tijd en moeite die nodig zijn voor toezicht verminderen.

Volgens Nick Bostrom zou de ontwikkeling van superintelligentie de existentiële risico's van andere geavanceerde technologieën zoals moleculaire nanotechnologie of synthetische biologie kunnen beperken. Door prioriteit te geven aan de ontwikkeling van superintelligentie vóór andere potentieel gevaarlijke technologieën, kan het algehele existentiële risico dus worden verlaagd.

Superintelligentie ontwikkelen om gewone KI te overheersen lijkt misschien het paard achter de wagen spannen, maar superintelligentie is misschien niet ver weg. Volgens "Situational Awareness" van Leopold Aschenbrenner zouden we superintelligentie binnen 10 jaar kunnen zien.

Explosie van kunstmatige intelligentie

Voor we het weten hebben we superintelligentie in handen - KI-systemen die veel slimmer zijn dan mensen, in staat tot nieuw, creatief, gecompliceerd gedrag dat we niet eens kunnen begrijpen - misschien zelfs een kleine beschaving van miljarden van hen. Hun kracht zou ook enorm zijn. Door superintelligentie toe te passen op onderzoek en ontwikkeling op andere gebieden, zou de explosieve vooruitgang verder gaan dan alleen onderzoek naar machinaal leren; al snel zouden ze robotica oplossen, binnen een paar jaar dramatische sprongen maken op andere gebieden van wetenschap en technologie en er zou een industriële explosie volgen. Superintelligentie zou waarschijnlijk een beslissend militair voordeel opleveren en ongekende vernietigingskrachten ontplooien. We zullen te maken krijgen met een van de meest intense en vluchtige momenten in de menselijke geschiedenis.