Zarządzanie ryzykiem związanym ze sztuczną inteligencją dla bezpieczniejszej przyszłości

Technologie oparte na sztucznej inteligencji szybko wkraczają we wszystkie aspekty życia: medycynę, edukację, finanse, media społecznościowe, autonomiczne pojazdy, programowanie itp. Postępu nie da się zatrzymać, więc wpływ sztucznej inteligencji będzie z roku na rok coraz większy. W naszym poprzednim artykule przeanalizowaliśmy zagrożenia związane ze sztuczną inteligencją, a teraz zbadamy, w jaki sposób można ograniczyć negatywne czynniki związane z jej wykorzystaniem.

Narzędzia do wykrywania sztucznej inteligencji

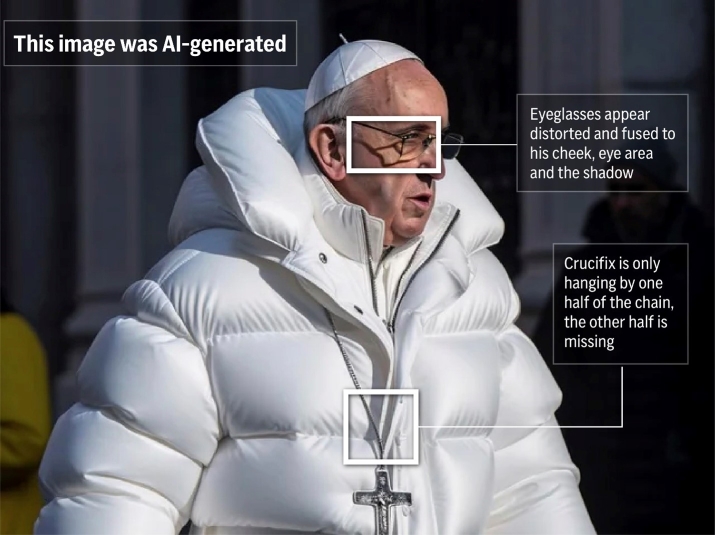

Za pomocą nowoczesnych technologii możliwe jest fabrykowanie dźwięku, zdjęć i filmów, tworzenie deepfake'ów, manipulowanie opinią publiczną, imitowanie głosu innej osoby i fałszowanie dowodów.

Naukowcy pracują obecnie nad sposobami wykrywania fałszerstw, pozwalającymi określić, czy nagranie audio lub wideo zostało zmienione, czy też w całości wygenerowane przez sztuczną inteligencję.

Wykrywanie wygenerowanych obrazów

- Intel stworzył pierwszą w historii platformę do wykrywania deepfake'ów w czasie rzeczywistym opartą na technologii FakeCatcher. Technologia ta wykorzystuje techniki zdalnej fotopletyzmografii do analizy subtelnego "przepływu krwi" w pikselach obrazu. Sygnały z wielu klatek są przetwarzane przez klasyfikator w celu ustalenia, czy dane wideo jest prawdziwe, czy fałszywe.

- Amerykańska agencja rządowa DARPA pracuje nad technologiami SemaFor (skrót od Semantic Forensics), które mogą dokładnie wykrywać syntetyczne, sztucznie wygenerowane obrazy.

Poza tym, istnieją już dziesiątki różnych narzędzi mających na celu wykrywanie wygenerowanych obrazów i tekstu.

Krytyczne myślenie

Dezinformacja, propaganda i różne metody oszustwa istniały na długo przed wynalezieniem sztucznej inteligencji. Być może ty lub ktoś, kogo znasz, był celem oszustów. Niektórzy ludzie łatwo dają się zwieść schematom takim jak "nigeryjski książę", podczas gdy inni są bardziej sceptyczni i myślą krytycznie. Wraz z rozwojem technologii, która może manipulować obrazami, dźwiękiem i wideo, musimy teraz jeszcze bardziej starannie sprawdzać fakty.

Futurysta Mark Ford powiedział: "Nikt nie wie, co jest prawdziwe, a co nie. To naprawdę prowadzi do sytuacji, w której dosłownie nie można wierzyć własnym oczom i uszom; nie można polegać na tym, co historycznie uważaliśmy za najlepsze możliwe dowody".

Przeciwdziałanie oszustwom i dezinformacji będzie procesem cyklicznym: gdy pojawią się nowe sposoby wykrywania oszustw, inni opracują sposoby przeciwdziałania im, co doprowadzi do stworzenia jeszcze większej liczby zabezpieczeń. Chociaż może to nie zapewniać pełnej ochrony, nie będziemy bezbronni.

Fałszywe zdjęcie papieża Franciszka

Tworzenie nowych miejsc pracy

Powszechne przyjęcie sztucznej inteligencji wiąże się z ryzykiem utraty miejsc pracy. Omówiliśmy ten problem szczegółowo w jednym z poprzednich artykułów. Można tam również znaleźć linki do badań, dowiedzieć się, które zawody są najbardziej zagrożone, a które nie.

Oczywiście wiele osób straci pracę z powodu sztucznej inteligencji (według różnych szacunków od 100 do 800 milionów osób), a niektórzy będą musieli przejść przekwalifikowanie zawodowe (Seo.ai szacuje ich liczbę na 120 milionów osób).

Sztuczna inteligencja będzie jednak nie tylko odbierać miejsca pracy, ale także tworzyć nowe. Co więcej, możliwy jest scenariusz, w którym nowe miejsca pracy pojawiają się szybciej niż znikają stare. Oto, co na ten temat pisze Światowe Forum Ekonomiczne:

Chociaż liczba zlikwidowanych miejsc pracy przewyższy liczbę utworzonych "miejsc pracy jutra", w przeciwieństwie do poprzednich lat, tworzenie miejsc pracy spowalnia, podczas gdy niszczenie miejsc pracy przyspiesza. Na podstawie tych danych szacujemy, że do 2025 r. 85 milionów miejsc pracy może zostać zastąpionych przez zmianę w podziale pracy między ludźmi a maszynami, podczas gdy 97 milionów nowych ról może się pojawić.

Wśród tych pojawiających się nowych miejsc pracy są:

- Inżynierowie ds. modeli i podpowiedzi AI

- Projektanci interfejsów i interakcji

- Twórcy treści AI

- Kuratorzy i trenerzy danych

- Specjaliści ds. etyki i zarządzania

Niektóre z nowych miejsc pracy

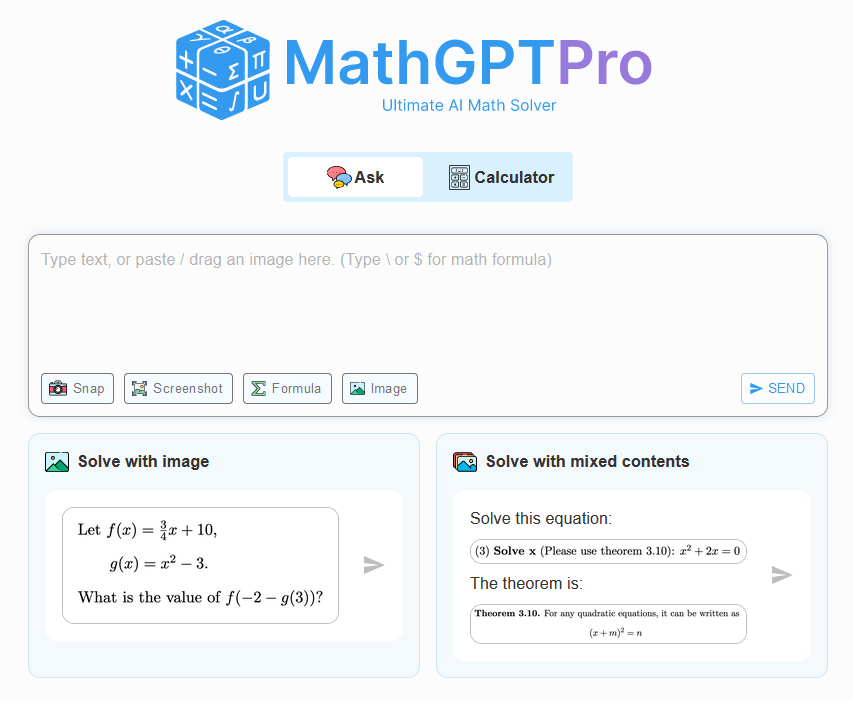

Przyjęcie technologii

Niektórzy nauczyciele obawiają się, że uczniowie mogą nie rozwinąć swoich umiejętności pisania, ponieważ SI wykona pracę za nich. Podobna sytuacja miała miejsce w latach 70. i 80. ubiegłego wieku, kiedy elektroniczne kalkulatory stały się powszechne. Nauczyciele matematyki martwili się, że uczniowie nie będą już uczyć się podstawowych działań arytmetycznych.

Zawsze istnieli przeciwnicy postępu. Tysiące lat temu, w starożytnej Grecji, Sokrates wypowiadał się przeciwko samemu pisaniu:

[Pisanie] spowoduje zapomnienie w duszach uczniów, ponieważ nie będą używać swojej pamięci; będą ufać zewnętrznym zapisanym znakom i nie będą pamiętać o sobie. Specyfika, którą odkryłeś, jest pomocą nie dla pamięci, ale dla wspomnień, a ty dajesz swoim uczniom nie prawdę, ale tylko pozór prawdy; będą słuchaczami wielu rzeczy i niczego się nie nauczą; będą wydawać się wszechwiedzący, a generalnie nic nie będą wiedzieć; będą męczącym towarzystwem, mając pozory mądrości bez rzeczywistości.

Nie jestem aż tak stary, by pamiętać starożytną Grecję, ale mój nauczyciel matematyki mawiał: "Nie zawsze będziesz mieć kalkulator w kieszeni". I zgadnij co? Mam kalkulator w kieszeni. To aplikacja na moim telefonie.

Postępu nie da się zatrzymać. Prędzej czy później ludzie będą musieli zaakceptować technologie oparte na sztucznej inteligencji. SI stanie się tak powszechnym narzędziem jak kalkulator.

MathGPT Pro

W tym miejscu musimy pamiętać, że chatboty są niedoskonałe, podatne na halucynacje, a generowane informacje muszą być dokładnie sprawdzane pod kątem dokładności. Jednak praca ze źródłami i podwójne sprawdzanie faktów jest powszechne w pracy edukacyjnej lub badawczej. Z czasem chatboty będą stawać się coraz lepsze i bardziej niezawodne - możemy to zaobserwować w ewolucji ChatGPT, od GPT-2 do GPT-4.

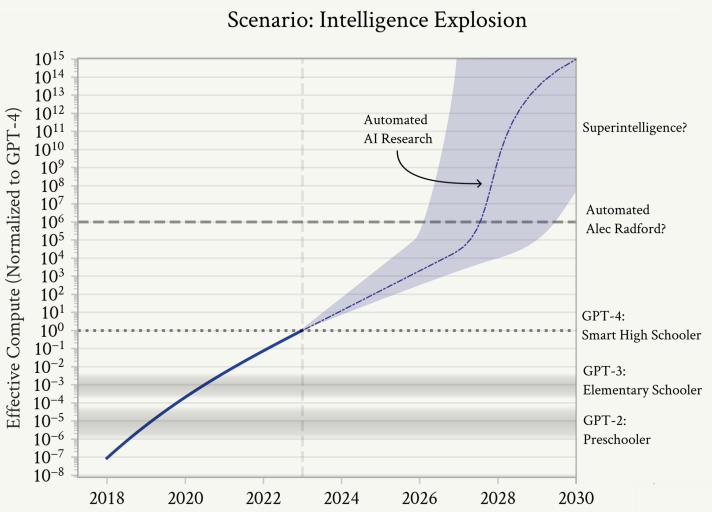

Skalowalny nadzór

W miarę jak systemy sztucznej inteligencji stają się coraz potężniejsze i bardziej złożone, coraz trudniejsze staje się kontrolowanie ich za pomocą ludzkich informacji zwrotnych. Ocena złożonych zachowań AI może być powolna lub niewykonalna dla ludzi, zwłaszcza gdy AI przewyższa ludzi w danej dziedzinie. Aby wykryć, kiedy wyniki sztucznej inteligencji są fałszywie przekonujące, ludzie potrzebują pomocy lub dużo czasu. Skalowalny nadzór może zmniejszyć czas i wysiłek potrzebny do nadzoru.

Według Nicka Bostroma rozwój superinteligencji mógłby potencjalnie złagodzić egzystencjalne zagrożenia stwarzane przez inne zaawansowane technologie, takie jak nanotechnologia molekularna czy biologia syntetyczna. Tym samym nadanie priorytetu stworzeniu superinteligencji przed innymi potencjalnie niebezpiecznymi technologiami mogłoby obniżyć ogólne ryzyko egzystencjalne.

Rozwijanie superinteligencji w celu nadzorowania zwykłej sztucznej inteligencji może wydawać się stawianiem wozu przed koniem, ale superinteligencja może nie być odległa. Według "Situational Awareness" autorstwa Leopolda Aschenbrennera, superinteligencję możemy zobaczyć już za 10 lat.

Eksplozja sztucznej inteligencji

Zanim się obejrzymy, będziemy mieli do czynienia z superinteligencją - systemami sztucznej inteligencji znacznie inteligentniejszymi od ludzi, zdolnymi do nowatorskich, kreatywnych i skomplikowanych zachowań, których nawet nie jesteśmy w stanie zrozumieć - być może nawet z małą cywilizacją złożoną z miliardów takich systemów. Ich moc również byłaby ogromna. Stosując superinteligencję w badaniach i rozwoju w innych dziedzinach, gwałtowny postęp rozszerzyłby się poza badania nad uczeniem maszynowym; wkrótce rozwiązaliby robotykę, dokonaliby dramatycznych skoków w innych dziedzinach nauki i technologii w ciągu kilku lat, a następnie nastąpiłaby eksplozja przemysłowa. Superinteligencja prawdopodobnie zapewniłaby decydującą przewagę militarną i rozwinęłaby niewyobrażalne moce zniszczenia. Będziemy mieli do czynienia z jednym z najbardziej intensywnych i niestabilnych momentów w historii ludzkości.