Управление рисками искусственного интеллекта для более безопасного будущего

Технологии, основанные на искусственном интеллекте, быстро проникают во все сферы жизни: медицину, образование, финансы, социальные сети, автономные транспортные средства, программирование и т. д. Остановить прогресс невозможно, поэтому влияние ИИ с каждым годом будет только усиливаться. В нашей предыдущей статье мы рассмотрели риски искусственного интеллекта, а теперь узнаем, как можно уменьшить негативные факторы, связанные с его использованием.

Средства обнаружения ИИ

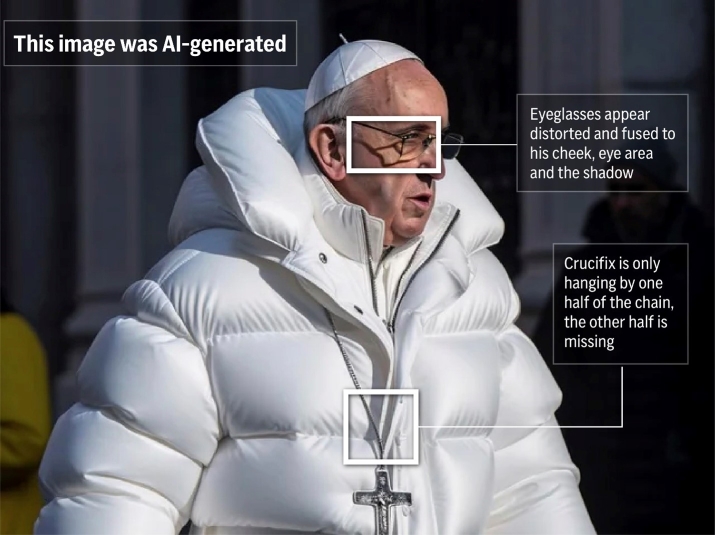

С помощью современных технологий можно сфабриковать аудио-, фото- и видеоматериалы, создать глубокие подделки, манипулировать общественным мнением, имитировать чужой голос и фальсифицировать доказательства.

Сейчас исследователи работают над способами обнаружения подделок, позволяющими определить, была ли аудио- или видеозапись изменена или полностью сгенерирована искусственным интеллектом.

Обнаружение сгенерированных изображений

- Компания Intel создала первую в истории платформу для обнаружения фейков в режиме реального времени на основе технологии FakeCatcher. Технология использует методы дистанционной фотоплетизмографии для анализа едва заметного "кровотока" в пикселях изображения. Сигналы с нескольких кадров обрабатываются классификатором, чтобы определить, является ли данное видео настоящим или поддельным.

- Американское государственное агентство DARPA работает над технологиями SemaFor (сокращение от Semantic Forensics), которые позволяют точно обнаруживать синтетические искусственно созданные изображения.

Кроме того, уже существуют десятки различных инструментов, предназначенных для обнаружения сгенерированных изображений и текста.

Критическое мышление

Дезинформация, пропаганда и различные методы обмана существовали задолго до изобретения искусственного интеллекта. Возможно, вы или кто-то из ваших знакомых становились жертвой мошенников. Некоторых людей легко обмануть с помощью таких схем, как рассылка наследства от "нигерийского принца", другие же более скептичны и мыслят критически. С развитием технологий, позволяющих манипулировать изображениями, аудио- и видеоматериалами, мы должны еще тщательнее проверять факты.

Футурист Марк Форд сказал: "Никто не знает, что реально, а что нет. Так что это действительно приводит к ситуации, когда вы буквально не можете верить своим глазам и ушам; вы не можете полагаться на то, что исторически мы считали наилучшими возможными доказательствами".

Борьба с мошенничеством и дезинформацией будет циклическим процессом: по мере появления новых способов обнаружения обмана другие будут разрабатывать способы противодействия им, что приведет к созданию еще большего количества защитных средств. Хотя это и не обеспечит полной защиты, мы не останемся беззащитными.

Поддельная фотография Папы Франциска

Создание новых рабочих мест

Повсеместное внедрение искусственного интеллекта сопряжено с риском потери рабочих мест. Мы подробно обсуждали эту проблему в одной из предыдущих статей. Там же вы можете найти ссылки на исследования, узнать, какие профессии наиболее подвержены риску, а какие - нет.

Конечно, многие люди потеряют работу из-за искусственного интеллекта (по разным оценкам, от 100 до 800 миллионов человек), а некоторым придется пройти профессиональную переподготовку (Seo.ai оценивает их число в 120 миллионов человек).

Однако ИИ будет не только отнимать рабочие места, но и создавать новые. Более того, возможен сценарий, при котором новые рабочие места будут появляться быстрее, чем исчезать старые. Вот что пишет об этом Всемирный экономический форум:

Хотя количество уничтоженных рабочих мест будет превышать количество созданных "рабочих мест завтрашнего дня", в отличие от предыдущих лет, создание рабочих мест замедляется, в то время как их уничтожение ускоряется. Исходя из этих данных, мы предполагаем, что к 2025 году в результате изменения разделения труда между людьми и машинами может быть ликвидировано 85 миллионов рабочих мест, а также появится 97 миллионов новых профессий.

К числу новых рабочих мест относятся:

- Инженеры по разработке моделей и промтов искусственного интеллекта

- Дизайнеры интерфейсов и взаимодействия

- Создатели контента ИИ

- Кураторы и инструкторы по работе с данными

- Специалисты по этике и управлению

Некоторые из новых рабочих мест

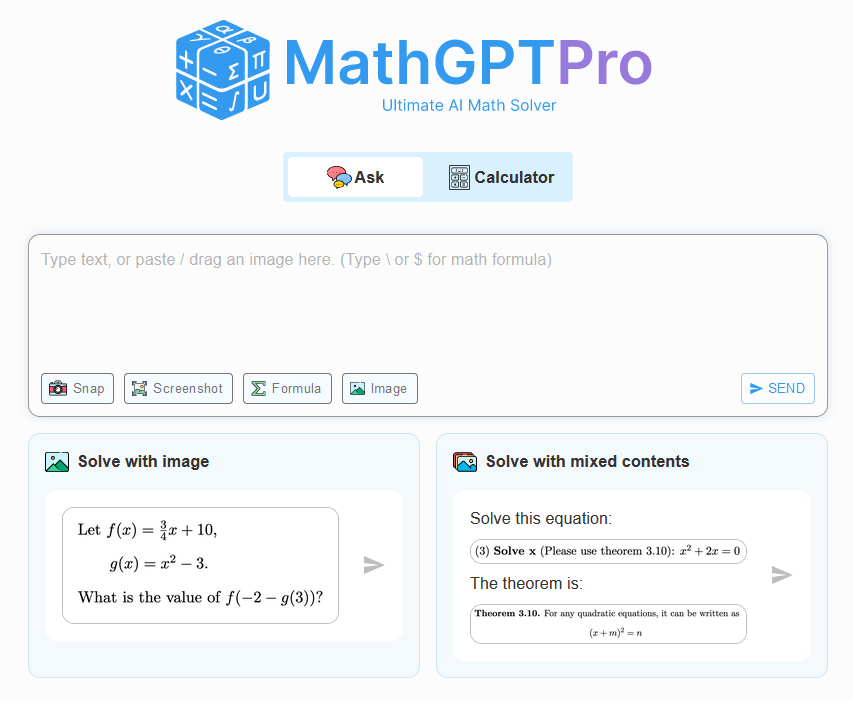

Принятие технологии

Некоторые преподаватели опасаются, что ученики могут не развить свои навыки письма, потому что за них все сделает искусственный интеллект. Похожая ситуация была в 1970-х и 1980-х годах, когда широкое распространение получили электронные калькуляторы. Учителя математики беспокоились, что ученики перестанут изучать основы арифметики.

Противники прогресса были всегда. Тысячи лет назад в Древней Греции Сократ выступал против письменности как таковой:

[Письмо] породит в душах учеников забвение, потому что они не будут пользоваться своей памятью; они будут доверять внешним письменным знакам и не будут помнить о себе. Открытая вами специфика помогает не памяти, а воспоминаниям, и вы даете своим ученикам не истину, а лишь видимость истины; они будут много слушать и ничему не научатся; они будут казаться всезнающими и в целом ничего не будут знать; они будут утомительной компанией, имея видимость мудрости без реальности.

Я не настолько древний, чтобы помнить Древнюю Грецию, но мой учитель математики говорил: "У вас не всегда будет калькулятор в кармане". И знаете что? У меня в кармане есть калькулятор. Это приложение на моем телефоне.

Прогресс нельзя остановить. Рано или поздно людям придется принять технологии, основанные на искусственном интеллекте. ИИ станет таким же обычным инструментом, как калькулятор.

MathGPT Pro

При этом следует помнить, что чат-боты несовершенны, склонны к галлюцинациям, а генерируемая информация нуждается в тщательной проверке на достоверность. Однако работа с источниками и перепроверка фактов - обычное дело в образовательной или исследовательской работе. И со временем чат-боты станут лучше и надежнее - мы можем наблюдать это на примере эволюции ChatGPT, от GPT-2 до GPT-4.

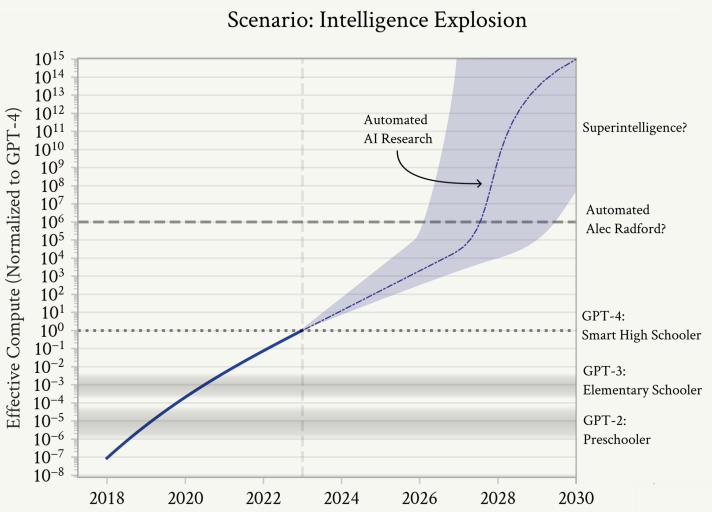

Масштабируемый надзор

По мере того как системы ИИ становятся все более мощными и сложными, контролировать их с помощью обратной связи с человеком становится все сложнее. Оценка сложного поведения ИИ может быть медленной или неосуществимой, особенно если ИИ превосходит человека в определенной области. Чтобы обнаружить, что результаты работы ИИ ложно убедительны, человеку требуется помощь или много времени. Масштабируемый надзор может сократить время и усилия, необходимые для контроля.

По мнению Ника Бострома, развитие сверхинтеллекта может потенциально смягчить экзистенциальные риски, создаваемые другими передовыми технологиями, такими как молекулярные нанотехнологии или синтетическая биология. Таким образом, установление приоритета создания сверхинтеллекта перед другими потенциально опасными технологиями может снизить общий экзистенциальный риск.

Разработка сверхинтеллекта для контроля над обычным ИИ может показаться забеганием вперед, но сверхинтеллект может быть не за горами. Согласно статье "Ситуационная осведомленность" Леопольда Ашенбреннера, мы можем увидеть сверхразум уже через 10 лет.

Взрыв искусственного интеллекта

Не успеем мы оглянуться, как у нас на руках окажется сверхразум - системы ИИ, намного умнее людей, способные на новое, творческое, сложное поведение, которое мы даже не можем понять, - возможно, даже небольшая цивилизация, состоящая из миллиардов таких систем. Их мощь тоже будет огромной. Если применить суперинтеллект к исследованиям и разработкам в других областях, взрывной прогресс выйдет за рамки только исследований в области машинного обучения; вскоре они решат проблему робототехники, сделают резкий скачок в других областях науки и техники в течение нескольких лет, и за этим последует промышленный взрыв. Сверхинтеллект, вероятно, обеспечит решающее военное преимущество и откроет несметные возможности для разрушения. Мы столкнемся с одним из самых напряженных и нестабильных моментов в истории человечества.