Riadenie rizík umelej inteligencie pre bezpečnejšiu budúcnosť

Technológie založené na umelej inteligencii sa rýchlo dostávajú do všetkých oblastí života: medicíny, vzdelávania, financií, sociálnych médií, autonómnych vozidiel, programovania atď. Pokrok sa nedá zastaviť, takže vplyv umelej inteligencie sa bude každým rokom len rozširovať. V našom predchádzajúcom článku sme sa zaoberali rizikami umelej inteligencie a teraz budeme skúmať, ako možno znížiť negatívne faktory spojené s používaním umelej inteligencie.

Nástroje na detekciu umelej inteligencie

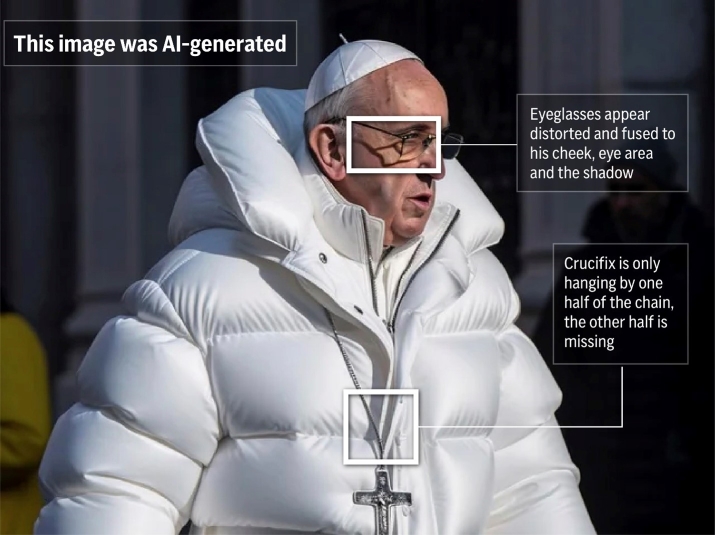

Pomocou moderných technológií je možné falšovať zvuky, fotografie a videá, vytvárať deepfakes, manipulovať verejnú mienku, napodobňovať hlas inej osoby a falšovať dôkazy.

Výskumníci v súčasnosti pracujú na spôsoboch odhaľovania falzifikátov, ktoré im umožnia určiť, či bol zvukový alebo obrazový záznam pozmenený alebo úplne vytvorený umelou inteligenciou.

Zisťovanie vytvorených obrázkov

- Spoločnosť Intel vytvorila vôbec prvú platformu na detekciu falošných údajov v reálnom čase založenú na technológii FakeCatcher. Táto technológia využíva techniky diaľkovej fotopletyzmografie na analýzu jemného "toku krvi" v pixeloch obrazu. Signály z viacerých snímok sa spracúvajú prostredníctvom klasifikátora s cieľom určiť, či je dané video skutočné alebo falošné.

- Americká vládna agentúra DARPA pracuje na technológiách SemaFor (skratka pre Semantic Forensics), ktoré dokážu presne odhaliť syntetické umelo vytvorené obrazy.

Okrem toho už existujú desiatky rôznych nástrojov zameraných na detekciu generovaných obrázkov a textov.

Kritické myslenie

Dezinformácie, propaganda a rôzne metódy klamania tu boli dávno pred vynájdením umelej inteligencie. Možno ste sa vy alebo niekto z vašich známych stali terčom podvodníkov. Niektorí ľudia sa dajú ľahko oklamať schémami, ako je napríklad e-mail o dedičstve "nigérijského princa", zatiaľ čo iní sú skeptickejší a myslia kriticky. S rozvojom technológií, ktoré dokážu manipulovať s obrázkami, zvukom a videom, musíme teraz ešte dôslednejšie preverovať fakty.

Futurológ Mark Ford povedal: "Nikto nevie, čo je skutočné a čo nie. Takže to naozaj vedie k situácii, keď doslova nemôžete veriť vlastným očiam a ušiam; nemôžete sa spoliehať na to, čo sme historicky považovali za najlepší možný dôkaz."

Boj proti podvodom a dezinformáciám bude cyklickým procesom: keď sa objavia nové spôsoby odhaľovania podvodov, iní vyvinú spôsoby, ako im čeliť, čo povedie k vytvoreniu ešte väčšieho počtu ochranných opatrení. Aj keď to nemusí poskytovať úplnú ochranu, nebudeme bezbranní.

Falošná fotografia pápeža Františka

Vytváranie nových pracovných miest

Rozsiahle zavádzanie umelej inteligencie je spojené s rizikom straty pracovných miest. Tomuto problému sme sa podrobne venovali v jednom z predchádzajúcich článkov. Tam nájdete aj odkazy na štúdie, dozviete sa, ktoré profesie sú najviac ohrozené a ktoré nie.

Samozrejme, veľa ľudí príde v dôsledku umelej inteligencie o prácu (podľa rôznych odhadov od 100 do 800 miliónov ľudí) a niektorí budú musieť absolvovať odbornú rekvalifikáciu (Seo.ai odhaduje ich počet na 120 miliónov ľudí).

Umelá inteligencia však bude nielen odoberať pracovné miesta, ale aj vytvárať nové. Okrem toho je možný scenár, keď nové pracovné miesta vznikajú rýchlejšie, ako staré zanikajú. Tu je to, čo o tom píše Svetové ekonomické fórum:

Hoci počet zrušených pracovných miest prekoná počet vytvorených "pracovných miest zajtrajška", na rozdiel od predchádzajúcich rokov sa tvorba pracovných miest spomaľuje, zatiaľ čo ich likvidácia sa zrýchľuje. Na základe týchto údajov odhadujeme, že do roku 2025 môže byť v dôsledku zmeny deľby práce medzi ľuďmi a strojmi zrušených 85 miliónov pracovných miest, pričom môže vzniknúť 97 miliónov nových pracovných pozícií.

Medzi tieto nové pracovné miesta patria:

- Inžinieri pre modelovanie a navrhovanie umelej inteligencie

- Návrhári rozhrania a interakcie

- Tvorcovia obsahu s umelou inteligenciou

- Kurátori a školitelia údajov

- Špecialisti na etiku a riadenie

Niektoré z nových pracovných miest

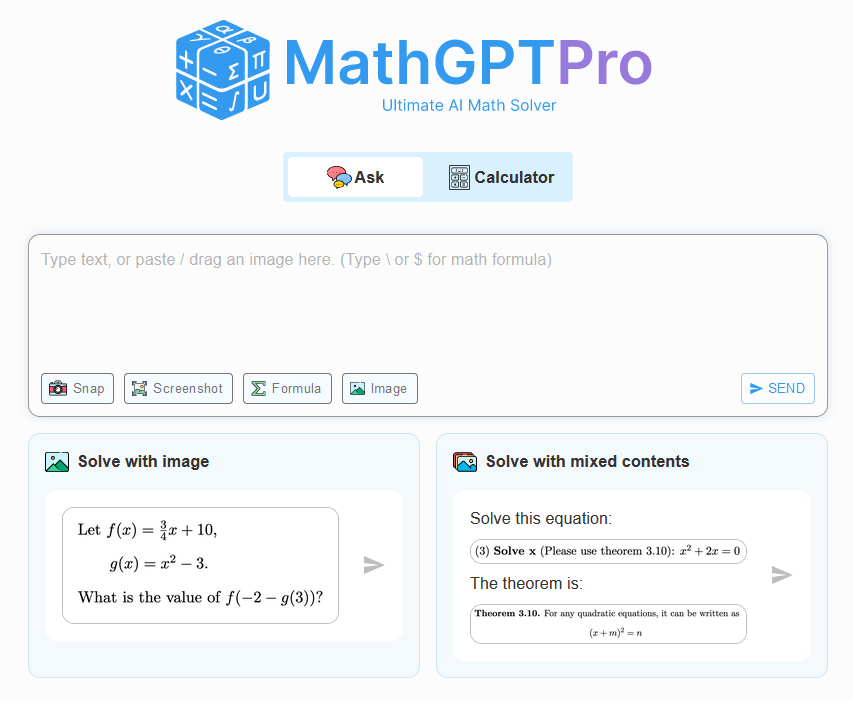

Prijatie technológie

Niektorí učitelia sa obávajú, že žiaci nebudú rozvíjať svoje zručnosti v písaní, pretože prácu za nich urobí umelá inteligencia. Podobná situácia bola v 70. a 80. rokoch minulého storočia, keď sa rozšírili elektronické kalkulačky. Učitelia matematiky sa obávali, že žiaci sa už nebudú učiť základné aritmetické úkony.

Vždy existovali odporcovia pokroku. Pred tisíckami rokov, v starovekom Grécku, Sokrates vystupoval proti samotnému písaniu:

[Písanie] spôsobí v dušiach žiakov zabudnutie, pretože nebudú používať svoju pamäť, budú dôverovať vonkajším písaným znakom a nebudú si pamätať na seba. Špecifikum, ktoré ste objavili, nie je pomôckou na pamäť, ale na spomínanie, a svojim žiakom nedáte pravdu, ale len zdanie pravdy; budú počúvať mnohé veci a nič sa nenaučia; budú sa tváriť, že sú vševediaci, a vo všeobecnosti nebudú vedieť nič; budú únavnou spoločnosťou, majúc zdanie múdrosti bez skutočnosti.

Nie som taký starý, aby som si pamätal staroveké Grécko, ale môj učiteľ matematiky hovorieval: "Kalkulačku nebudeš mať vždy vo vrecku." A hádajte čo? Kalkulačku vo vrecku naozaj mám. Je to aplikácia v mojom telefóne.

Pokrok sa nedá zastaviť. Skôr či neskôr budú musieť ľudia prijať technológie založené na umelej inteligencii. Umelá inteligencia sa stane rovnako bežným nástrojom ako kalkulačka.

MathGPT Pro

V tejto chvíli si musíme uvedomiť, že chatboti sú nedokonalí, náchylní na halucinácie a správnosť generovaných informácií je potrebné starostlivo kontrolovať. Práca so zdrojmi a dvojitá kontrola faktov je však vo vzdelávacej alebo výskumnej práci bežná. A časom sa chatboty stanú lepšími a spoľahlivejšími - môžeme to vidieť na vývoji ChatGPT, od GPT-2 po GPT-4.

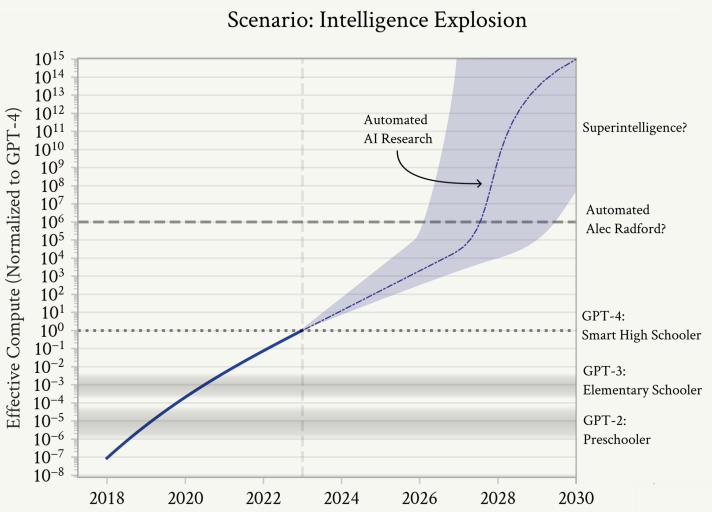

Škálovateľný dohľad

Keďže systémy umelej inteligencie sú čoraz výkonnejšie a zložitejšie, je čoraz náročnejšie kontrolovať ich prostredníctvom spätnej väzby od človeka. Pre ľudí môže byť pomalé alebo neuskutočniteľné vyhodnocovať komplexné správanie UI, najmä ak UI v danej oblasti prekonáva ľudí. Na odhalenie toho, kedy je výstup UI falošne presvedčivý, potrebujú ľudia pomoc alebo rozsiahly čas. Škálovateľný dohľad môže znížiť čas a úsilie potrebné na dohľad.

Podľa Nicka Bostroma by vývoj superinteligencie mohol potenciálne zmierniť existenčné riziká, ktoré predstavujú iné pokročilé technológie, ako napríklad molekulárna nanotechnológia alebo syntetická biológia. Uprednostnenie vytvorenia superinteligencie pred inými potenciálne nebezpečnými technológiami by teda mohlo znížiť celkové existenčné riziko.

Vývoj superinteligencie, ktorá bude dohliadať na bežnú umelú inteligenciu, sa môže zdať ako predbiehanie voza pred koňom, ale superinteligencia nemusí byť ďaleko. Podľa článku "Situational Awareness" od Leopolda Aschenbrennera by sme sa superinteligencie mohli dočkať už o 10 rokov.

Explózia umelej inteligencie

Skôr než sa nazdáme, budeme mať v rukách superinteligenciu - systémy umelej inteligencie oveľa inteligentnejšie ako ľudia, schopné nového, kreatívneho a komplikovaného správania, ktorému ani nedokážeme porozumieť - možno dokonca malú civilizáciu pozostávajúcu z miliárd takýchto systémov. Ich sila by bola tiež obrovská. Aplikovaním superinteligencie na výskum a vývoj v iných oblastiach by sa explozívny pokrok rozšíril nielen na výskum strojového učenia; čoskoro by vyriešili robotiku, v priebehu rokov by urobili dramatický skok v iných oblastiach vedy a techniky a nasledovala by priemyselná explózia. Superinteligencia by pravdepodobne poskytla rozhodujúcu vojenskú výhodu a rozvinula by nevýslovné ničivé sily. Čakal by nás jeden z najintenzívnejších a najvýbušnejších momentov v dejinách ľudstva.