Obvladovanje tveganj umetne inteligence za varnejšo prihodnost

Tehnologije, ki temeljijo na umetni inteligenci, hitro prodirajo v vse vidike življenja: medicino, izobraževanje, finance, družbene medije, avtonomna vozila, programiranje itd. Napredka ni mogoče ustaviti, zato se bo vpliv umetne inteligence vsako leto le še povečeval. V prejšnjem članku smo preučili tveganja umetne inteligence, zdaj pa bomo raziskali, kako je mogoče zmanjšati negativne dejavnike, povezane z uporabo umetne inteligence.

Orodja za odkrivanje umetne inteligence

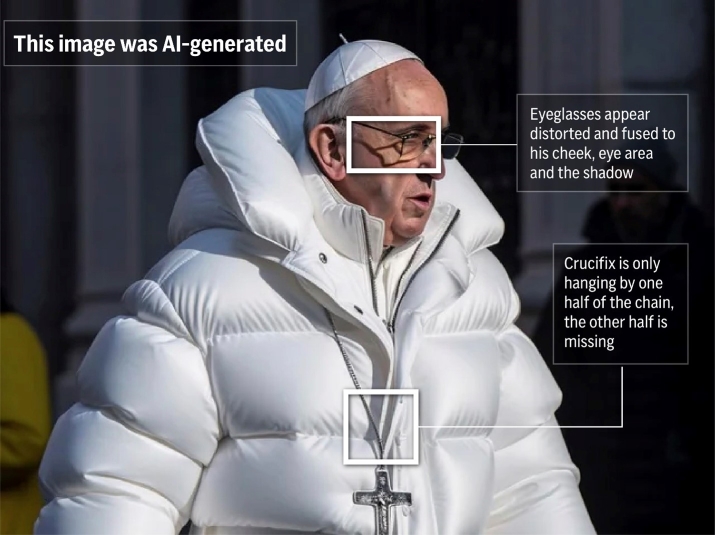

S sodobnimi tehnologijami je mogoče ponarejati zvok, fotografije in videoposnetke, ustvarjati globoke ponaredke, manipulirati z javnim mnenjem, posnemati glas druge osebe in ponarejati dokaze.

Raziskovalci zdaj razvijajo načine za odkrivanje ponaredkov, s katerimi lahko ugotovijo, ali je bil zvočni ali video posnetek spremenjen ali pa ga je v celoti ustvarila umetna inteligenca.

Zaznavanje ustvarjenih slik

- Intel je na podlagi tehnologije FakeCatcher ustvaril prvo platformo za odkrivanje lažnih podatkov v realnem času. Tehnologija uporablja tehnike fotopletizmografije na daljavo za analizo subtilnega "pretoka krvi" v pikslih slike. Signali iz več posnetkov se obdelajo s pomočjo klasifikatorja, ki določi, ali je zadevni videoposnetek resničen ali ponarejen.

- Ameriška vladna agencija DARPA se ukvarja s tehnologijami SemaFor (kratica za Semantic Forensics), ki lahko natančno zaznajo sintetične umetno ustvarjene slike.

Poleg tega že obstaja na desetine različnih orodij, namenjenih odkrivanju ustvarjenih slik in besedil.

Kritično razmišljanje

Dezinformacije, propaganda in različne metode zavajanja so bile znane že dolgo pred izumom umetne inteligence. Morda ste bili vi ali kdo od vaših znancev tarča prevarantov. Nekatere ljudi zlahka prevarajo sheme, kot je elektronsko sporočilo o dedovanju "nigerijskega princa", drugi pa so bolj skeptični in razmišljajo kritično. Z razvojem tehnologije, ki lahko manipulira s slikami, zvokom in videom, moramo zdaj še bolj vestno preverjati dejstva.

Futurist Mark Ford je dejal: "Nihče ne ve, kaj je resnično in kaj ne. Tako se res zgodi, da dobesedno ne morete verjeti lastnim očem in ušesom; ne morete se zanašati na to, kar smo v preteklosti imeli za najboljše možne dokaze."

Boj proti prevaram in dezinformacijam bo cikličen proces: ko se bodo pojavili novi načini za odkrivanje prevar, bodo drugi razvili načine za njihovo preprečevanje, kar bo vodilo k oblikovanju še več zaščitnih ukrepov. Čeprav morda ne bo zagotovljena popolna zaščita, ne bomo brez zaščite.

Ponarejena fotografija papeža Frančiška

Ustvarjanje novih delovnih mest

Široka uporaba umetne inteligence prinaša tveganje izgube delovnih mest. O tem problemu smo podrobno razpravljali v enem od prejšnjih člankov. V njem lahko najdete tudi povezave do študij in ugotovite, kateri poklici so najbolj ogroženi in kateri niso ogroženi.

Seveda bo veliko ljudi zaradi umetne inteligence izgubilo službo (po različnih ocenah od 100 do 800 milijonov ljudi), nekateri pa se bodo morali poklicno prekvalificirati (Seo.ai njihovo število ocenjuje na 120 milijonov ljudi).

Vendar pa umetna inteligenca ne bo le odvzemala delovnih mest, temveč tudi ustvarjala nova. Poleg tega je možen scenarij, ko se nova delovna mesta pojavljajo hitreje, kot izginjajo stara. O tem piše Svetovni gospodarski forum:

Čeprav bo število uničenih delovnih mest preseglo število ustvarjenih "delovnih mest prihodnosti", se v nasprotju s prejšnjimi leti ustvarjanje delovnih mest upočasnjuje, medtem ko se uničevanje delovnih mest pospešuje. Na podlagi teh podatkov ocenjujemo, da bo do leta 2025 zaradi spremembe delitve dela med ljudmi in stroji zamenjanih 85 milijonov delovnih mest, nastalo pa bo 97 milijonov novih vlog.

Med temi novimi delovnimi mesti so:

- Inženirji za modele in predloge umetne inteligence

- Oblikovalci vmesnikov in interakcij

- Ustvarjalci vsebin z umetno inteligenco

- Kuratorji in trenerji podatkov

- Strokovnjaki za etiko in upravljanje

Nekatera nova delovna mesta

Sprejemanje tehnologije

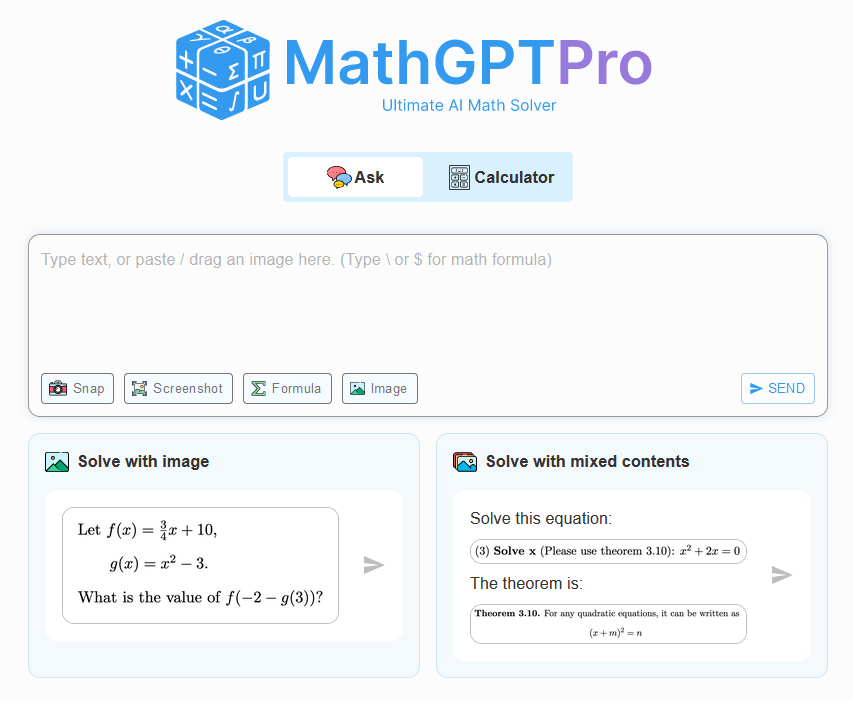

Nekateri učitelji so zaskrbljeni, da učenci ne bodo razvijali svojih pisnih spretnosti, ker bo delo namesto njih opravila umetna inteligenca. Podobno je bilo v sedemdesetih in osemdesetih letih prejšnjega stoletja, ko so se razširili elektronski kalkulatorji. Učitelji matematike so bili zaskrbljeni, da se učenci ne bodo več učili osnovnih aritmetičnih računov.

Vedno so obstajali nasprotniki napredka. Pred tisočletji je v stari Grčiji Sokrat nasprotoval samemu pisanju:

[Pisanje] bo v učenčevih dušah povzročilo pozabo, saj ne bodo uporabljali svojega spomina; zaupali bodo zunanjim pisnim znakom in se ne bodo spominjali samih sebe. Posebnost, ki ste jo odkrili, ni pomoč za spomin, temveč za spominjanje, in svojim učencem ne dajete resnice, temveč le videz resnice; bili bodo poslušalci mnogih stvari in se ne bodo ničesar naučili; zdeli se bodo vsevedni, a na splošno ne bodo vedeli ničesar; bili bodo dolgočasna družba, saj bodo imeli videz modrosti brez resničnosti.

Nisem tako star, da bi se spominjal stare Grčije, a moj učitelj matematike je govoril: "V žepu ne boš imel vedno kalkulatorja." In uganite kaj? V žepu imam kalkulator. To je aplikacija v mojem telefonu.

Napredka ni mogoče ustaviti. Prej ali slej bodo ljudje morali sprejeti tehnologije, ki temeljijo na umetni inteligenci. Umetna inteligenca bo postala tako običajno orodje kot kalkulator.

MathGPT Pro

Pri tem ne smemo pozabiti, da so klepetalni roboti nepopolni, nagnjeni k halucinacijam in da je treba skrbno preveriti točnost ustvarjenih informacij. Vendar pa je delo z viri in dvojno preverjanje dejstev pri izobraževalnem ali raziskovalnem delu nekaj povsem običajnega. In sčasoma bodo klepetalni roboti postali boljši in zanesljivejši - to lahko vidimo v razvoju ChatGPT, od GPT-2 do GPT-4.

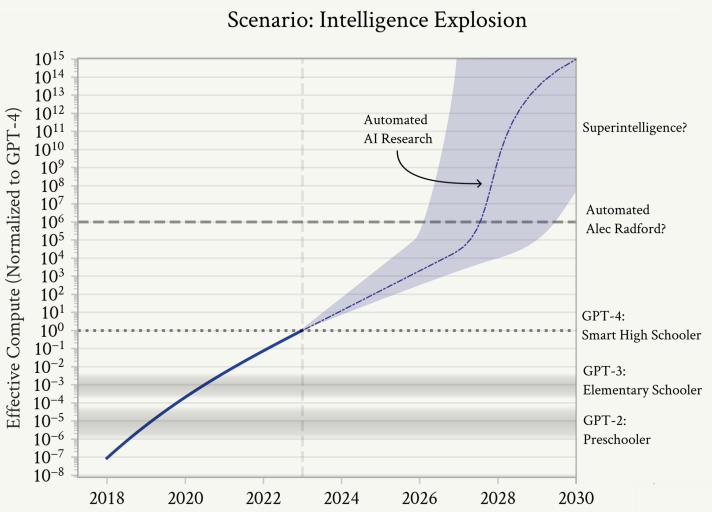

Skalabilen nadzor

Ker sistemi umetne inteligence postajajo vse zmogljivejši in kompleksnejši, je vse težje nadzirati jih s pomočjo človeških povratnih informacij. Ocenjevanje zapletenega vedenja UI je lahko za ljudi počasno ali neizvedljivo, zlasti kadar UI na določenem področju prekaša človeka. Da bi odkrili, kdaj je rezultat UI lažno prepričljiv, ljudje potrebujejo pomoč ali veliko časa. Z razširljivim nadzorom lahko zmanjšamo čas in napor, ki sta potrebna za nadzor.

Po mnenju Nicka Bostroma bi lahko razvoj superinteligence potencialno ublažil eksistenčna tveganja, ki jih predstavljajo druge napredne tehnologije, kot sta molekularna nanotehnologija ali sintetična biologija. Če bi torej dali prednost razvoju superinteligence pred drugimi potencialno nevarnimi tehnologijami, bi lahko zmanjšali splošno eksistenčno tveganje.

Razvoj superinteligence za nadzor običajne umetne inteligence se morda zdi, kot da postavljamo voz pred konja, vendar superinteligenca morda ni več daleč. V skladu s člankom "Situational Awareness" Leopolda Aschenbrennerja bi lahko superinteligenco videli že čez 10 let.

Eksplozija umetne inteligence

Še preden bi se zavedali, bi imeli superinteligenco - sisteme umetne inteligence, ki bi bili veliko pametnejši od ljudi, sposobni novega, ustvarjalnega in zapletenega vedenja, ki ga ne bi mogli niti razumeti - morda celo majhno civilizacijo z več milijardami takšnih sistemov. Tudi njihova moč bi bila velika. Z uporabo superinteligence pri raziskavah in razvoju na drugih področjih bi se eksplozivni napredek razširil z zgolj raziskav strojnega učenja; kmalu bi rešili robotiko, v nekaj letih bi naredili dramatičen preskok na drugih področjih znanosti in tehnologije, čemur bi sledila industrijska eksplozija. Superinteligenca bi verjetno zagotovila odločilno vojaško prednost in razvila nepopisne uničevalne moči. Znašli bi se pred enim najbolj intenzivnih in nestanovitnih trenutkov v človeški zgodovini.