Hantering av riskerna med artificiell intelligens för en säkrare framtid

Teknik som bygger på artificiell intelligens gör snabbt sitt intåg i alla livets aspekter: medicin, utbildning, ekonomi, sociala medier, självkörande fordon, programmering osv. Framstegen kan inte hejdas, så effekterna av AI kommer bara att fortsätta att öka för varje år. I vår tidigare artikel undersökte vi riskerna med artificiell intelligens, och nu ska vi utforska hur de negativa faktorerna i samband med användningen av AI kan minskas.

Verktyg för att upptäcka AI

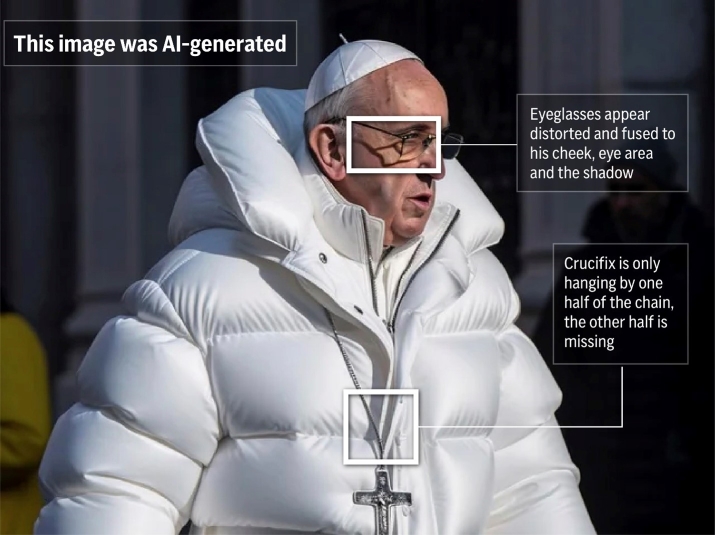

Med hjälp av modern teknik är det möjligt att fabricera ljud, foton och videor, skapa deepfakes, manipulera den allmänna opinionen, imitera en annan persons röst och förfalska bevis.

Forskare arbetar nu med att hitta sätt att upptäcka förfalskningar, så att de kan avgöra om en ljud- eller videoinspelning har ändrats eller helt och hållet genererats av artificiell intelligens.

Detektering av genererade bilder

- Intel skapade den första plattformen någonsin för deepfake-detektering i realtid baserad på FakeCatcher-teknik. Tekniken använder fjärranslutna fotopletysmografitekniker för att analysera det subtila "blodflödet" i pixlarna i en bild. Signalerna från flera bildrutor bearbetas genom en klassificerare för att avgöra om videon i fråga är äkta eller falsk.

- Den amerikanska myndigheten DARPA arbetar med SemaFor-teknik (en förkortning för Semantic Forensics) som kan upptäcka syntetiska, artificiellt genererade bilder.

Dessutom finns det redan dussintals olika verktyg som syftar till att upptäcka genererade bilder och text.

Kritiskt tänkande

Desinformation, propaganda och olika metoder för bedrägeri har funnits långt innan artificiell intelligens uppfanns. Kanske har du eller någon du känner blivit utsatt för bedragare. Vissa människor låter sig lätt luras av knep som "Nigerian prince", medan andra är mer skeptiska och tänker kritiskt. Med den ökande användningen av teknik som kan manipulera bilder, ljud och video måste vi nu vara ännu mer noggranna med att kontrollera fakta.

Futuristen Mark Ford sa: "Ingen vet vad som är verkligt och vad som inte är det. Så det leder verkligen till en situation där man bokstavligen inte kan tro sina egna ögon och öron; man kan inte förlita sig på det som vi historiskt sett har ansett vara bästa möjliga bevis."

Att motverka bedrägerier och felaktig information kommer att vara en cyklisk process: när nya sätt att upptäcka bedrägerier dyker upp kommer andra att utveckla sätt att motverka dem, vilket leder till att ännu fler skyddsåtgärder skapas. Även om det kanske inte ger ett fullständigt skydd kommer vi inte att vara försvarslösa.

Falskt foto av påven Franciskus

Skapande av nya jobb

Den utbredda användningen av artificiell intelligens medför en risk för att arbetstillfällen försvinner. Vi diskuterade detta problem i detalj i en av de tidigare artiklarna. Där kan du också hitta länkar till studier, ta reda på vilka yrken som är mest utsatta och vilka som inte är utsatta.

Naturligtvis kommer många människor att förlora sina jobb på grund av artificiell intelligens (enligt olika uppskattningar, från 100 till 800 miljoner människor), och vissa kommer att behöva genomgå professionell omskolning (Seo.ai uppskattar deras antal till 120 miljoner människor).

AI kommer dock inte bara att ta bort jobb, utan också skapa nya. Dessutom är ett scenario möjligt där nya jobb dyker upp snabbare än gamla försvinner. Så här skriver World Economic Forum om det:

Även om antalet jobb som försvinner kommer att överträffas av antalet "morgondagens jobb" som skapas, till skillnad från tidigare år, går jobbskapandet långsammare medan jobbförstöringen accelererar. Baserat på dessa siffror uppskattar vi att 85 miljoner jobb kan komma att försvinna fram till 2025 till följd av en förändrad arbetsfördelning mellan människor och maskiner, medan 97 miljoner nya roller kan komma att uppstå.

Bland dessa nya jobb som växer fram finns:

- Ingenjörer av AI-modeller och -prompt

- Gränssnitts- och interaktionsdesigners

- Skapare av AI-innehåll

- Datainventerare och utbildare

- Specialister på etik och styrning

Några av de nya jobben

Att omfamna tekniken

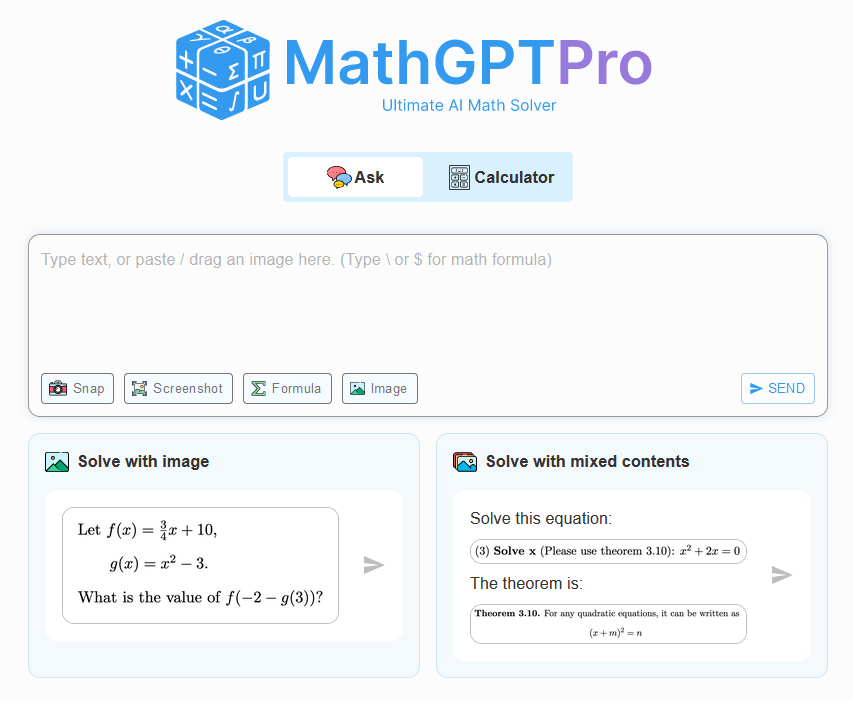

Vissa lärare är oroliga för att eleverna inte ska utveckla sina skrivfärdigheter eftersom AI kommer att göra jobbet åt dem. En liknande situation uppstod på 1970- och 1980-talen när de elektroniska miniräknarna blev allt vanligare. Matematiklärarna var oroliga för att eleverna inte längre skulle lära sig grundläggande aritmetik.

Det har alltid funnits motståndare till framsteg. För tusentals år sedan, i antikens Grekland, uttalade sig Sokrates mot själva skrivandet:

[Skrivandet] kommer att skapa glömska i elevernas själar, eftersom de inte kommer att använda sina minnen; de kommer att lita till de yttre skrivna tecknen och inte minnas av sig själva. Det specifika som ni har upptäckt är ett hjälpmedel inte för minnet utan för hågkomsten, och ni ger inte era lärjungar sanning utan endast skenet av sanning; de kommer att få höra många saker och kommer inte att ha lärt sig någonting; de kommer att framstå som allvetande och kommer i allmänhet inte att veta någonting; de kommer att vara ett tröttsamt sällskap, som har skenet av visdom utan verklighet.

Jag är inte så gammal att jag minns det antika Grekland, men min mattelärare brukade säga: "Du kommer inte alltid att ha en miniräknare i fickan." Och gissa vad? Jag har en miniräknare i min ficka. Det är en applikation på min telefon.

Framsteg kan inte stoppas. Förr eller senare kommer människor att behöva anamma teknik som bygger på artificiell intelligens. AI kommer att bli ett lika vanligt verktyg som en miniräknare.

MathGPT Pro

Här måste vi komma ihåg att chatbottar är ofullkomliga och kan få hallucinationer, och att den information som genereras måste kontrolleras noggrant för att säkerställa att den är korrekt. Att arbeta med källor och dubbelkolla fakta är dock vanligt inom utbildnings- och forskningsarbete. Och med tiden kommer chatbottar att bli bättre och mer tillförlitliga - vi kan se detta i utvecklingen av ChatGPT, från GPT-2 till GPT-4.

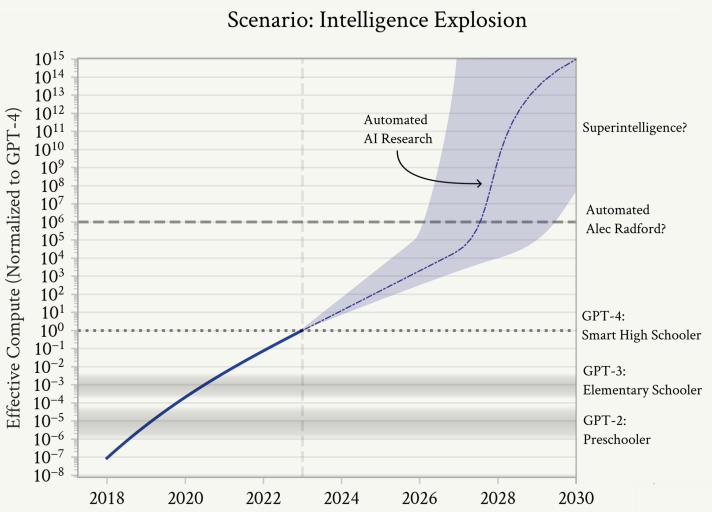

Skalbar tillsyn

I takt med att AI-systemen blir mer kraftfulla och komplexa blir det allt svårare att kontrollera dem genom mänsklig feedback. Det kan vara långsamt eller omöjligt för människor att utvärdera komplexa AI-beteenden, särskilt när AI överträffar människor inom en viss domän. För att upptäcka när AI:ns resultat är falskt övertygande behöver människor hjälp eller lång tid på sig. Skalbar tillsyn kan minska den tid och ansträngning som krävs för övervakning.

Enligt Nick Bostrom kan utvecklingen av superintelligens potentiellt mildra de existentiella risker som andra avancerade tekniker som molekylär nanoteknik eller syntetisk biologi utgör. Att prioritera skapandet av superintelligens före annan potentiellt farlig teknik skulle således kunna sänka den totala existentiella risken.

Att utveckla superintelligens för att övervaka vanlig AI kan tyckas vara att sätta vagnen före hästen, men superintelligens kanske inte är långt borta. Enligt "Situational Awareness" av Leopold Aschenbrenner kan vi få se superintelligens inom 10 år från och med nu.

Explosion av artificiell intelligens

Innan vi vet ordet av skulle vi ha superintelligens - AI-system som är mycket smartare än människor och som kan uppvisa nya, kreativa och komplicerade beteenden som vi inte ens kan börja förstå - och kanske till och med en liten civilisation med miljarder av dem. Deras makt skulle också vara enorm. Genom att tillämpa superintelligens på forskning och utveckling inom andra områden skulle explosiva framsteg breddas från att bara omfatta forskning om maskininlärning; snart skulle de lösa robotik, göra dramatiska språng inom andra områden inom vetenskap och teknik inom några år, och en industriell explosion skulle följa. Superintelligens skulle sannolikt ge en avgörande militär fördel och utveckla oanade förstörelsekrafter. Vi kommer att stå inför ett av de mest intensiva och instabila ögonblicken i mänsklighetens historia.