Förstå ChatGPT-inställningar: Temperatur, Top P, Presence penalty och Frequency penalty

Flexibiliteten och anpassningsmöjligheterna som ChatGPT:s parametrar erbjuder gör den till ett mångsidigt verktyg för olika uppgifter. Genom att justera parametrar som Temperatur, Top P, Presence penalty och Frequency penalty kan användarna finjustera modellens resultat så att det passar deras specifika behov. Oavsett om det handlar om kreativt skrivande, att generera korrekta svar eller att forma modellens språkliga stil, kan förståelse och användning av dessa parametrar avsevärt förbättra ChatGPT:s användbarhet och effektivitet.

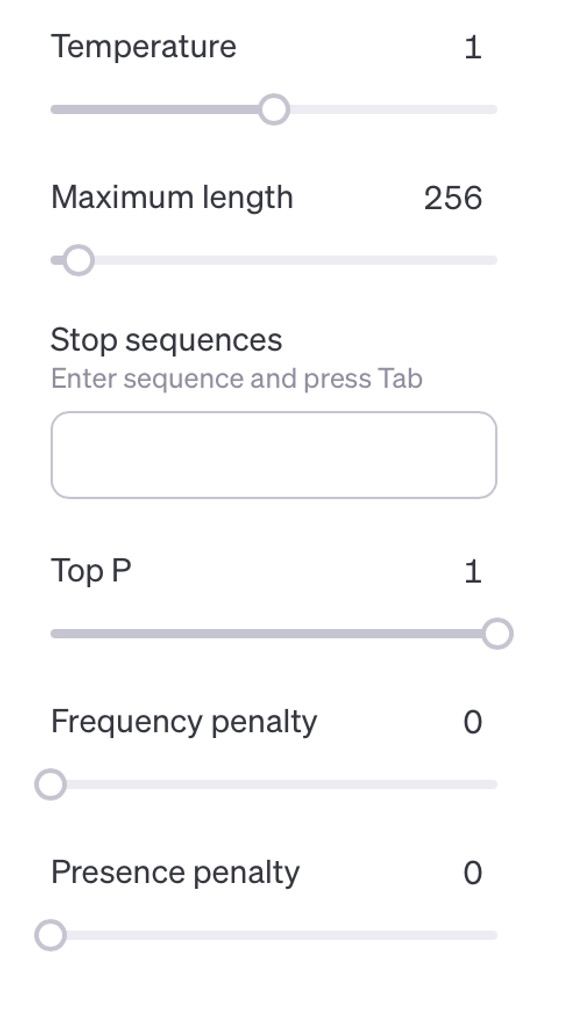

ChatGPT-inställningar

Temperatur

Temperaturen styr slumpmässigheten i det genererade svaret. Ett högre temperaturvärde ökar slumpmässigheten, vilket gör svaren mer varierade och kreativa, medan ett lägre värde gör dem mer fokuserade och deterministiska.

För kreativa skrivuppgifter eller brainstorming av idéer är ett högre temperaturvärde (t.ex. 0,8-1,0) ofta att föredra för att utforska olika möjligheter. För faktabaserade frågor eller när man vill generera exakta svar är däremot ett lägre temperaturvärde (t.ex. 0,2-0,5) att föredra för att säkerställa mer exakta och tillförlitliga svar.

Top P

Parametern Top P styr mångfalden i det genererade resultatet genom att trunkera sannolikhetsfördelningen för ord. Den fungerar som ett filter för att bestämma hur många ord eller fraser som språkmodellen ska undersöka när den förutsäger nästa ord. Om Top P-värdet t.ex. är 0,4 tar modellen endast hänsyn till 40 % av de mest sannolika orden eller fraserna.

Ett högre Top P-värde (t.ex. 0,9-1,0) ger ett bredare urval av alternativ, vilket resulterar i mer varierade svar. Detta kan vara användbart för kreativa uppgifter där man vill ha något nytt. Omvänt innebär ett lägre Top P-värde (t.ex. 0,1-0,5) att alternativen begränsas till de mest sannolika, vilket gör svaren mer fokuserade och sammanhängande.

Vad är skillnaden mellan Temperatur och Top P?

Top P definierar ett intervall av tokens (ord och symboler) som ChatGPT kan använda. När Top P = 1 kan språkmodellen använda vilken token som helst när den genererar ett svar. När Top P = 0,5 kan den bara använda 50% av de mest sannolika/lämpliga/vanliga alternativen.

Å andra sidan avgör temperaturen sannolikheten för att ChatGPT väljer en viss token. Med en temperatur på 1 har boten samma sannolikhet för alla tillgängliga alternativ (inom Top P-gränserna), medan lägre värden gör att den lutar sig mot mer frekvent använda ord och fraser.

Optimala värden för Temperatur och Topp P

De bästa temperatur- och Top P-värdena för olika uppgifter kan variera beroende på kundens eller publikationens specifika krav och preferenser.

- För artikelskrivning kan ett lägre temperaturvärde (t.ex. ca 0,5-0,7) och ett medelhögt till högt Top P-värde (t.ex. ca 0,8-0,9) bidra till att skapa mer fokuserade och sammanhängande artiklar samtidigt som AI-modellen fortfarande kan bidra med viss kreativitet.

- För produktbeskrivningar kan ett något högre temperaturvärde (t.ex. ca 0,7-0,8) och ett medelhögt Top P-värde (t.ex. ca 0,7-0,8) bidra till att skapa unika och engagerande beskrivningar som sticker ut för potentiella kunder.

- För språköversättning kan ett lägre temperaturvärde (t.ex. ca 0,5-0,7) och ett medelhögt till högt Top P-värde (t.ex. ca 0,8-0,9) bidra till att översättningen blir korrekt samtidigt som den låter naturlig.

För virtuella assistentuppgifter kan ett medeltemperaturvärde (t.ex. cirka 0,7-0,8) och ett medelhögt till högt Top P-värde (t.ex. cirka 0,8-0,9) bidra till att skapa interaktiva och hjälpsamma svar som är både informativa och engagerande. - För innehållskurering kan ett högre temperaturvärde (t.ex. cirka 0,8-0,9) och ett lågt Top P-värde (t.ex. cirka 0,2-0,4) möjliggöra mer kreativitet och mångfald i det kuraterade innehållet samtidigt som relevansen och kvaliteten bibehålls.

- Kodgenereringsuppgifter kräver precision och efterlevnad av konventioner. Ett lågt temperaturvärde på mellan 0,1 och 0,5 kan bidra till att generera korrekt och felfri kod. Det rekommenderas att använda ett lägre Top P-värde på cirka 0,2 för att minimera slumpmässighet och upprätthålla överensstämmelse med etablerade konventioner.

Presence penalty

Både Presence penalty och Frequency penalty hjälper till att undvika upprepning. De straffar båda användningen av samma ord om och om igen, men på lite olika sätt. Med Presence penalty straffas tokens baserat på om de förekommer i den genererade texten så här långt, oavsett hur ofta de förekommer.

Detta uppmuntrar ChatGPT att använda en mer varierad vokabulär. Ju högre värde för Presence penalty, desto mer uttalad blir bestraffningen.

Frequency penalty

Frequency penalty straffar tokens baserat på hur ofta de förekommer i texten så här långt. Om du märker att samma ord används ofta i det genererade resultatet kanske du vill öka värdet på denna parameter.

Att öka Presence penalty är som att säga till ChatGPT att inte använda repetitiva fraser eller idéer, medan att öka Frequency penalty är som att säga till att inte använda samma ord för ofta.

Optimala värden för Presence penalty och Frequency penalty

För att måttligt minska antalet repetitiva prov ligger lämpliga straffkoefficienter i allmänhet mellan 0,1 och 1. Men om målet är att avsevärt undertrycka repetition kan koefficienterna ökas upp till 2.

Det är dock viktigt att notera att denna ökning kan resultera i en märkbar minskning av provkvaliteten. Alternativt kan negativa värden användas för att avsiktligt öka sannolikheten för upprepning.